生成AI(Generative AI)のビジネス導入が爆発的に進む現在、多くの企業が直面している最大の壁。それは、AIが自信満々に嘘をつく現象――「ハルシネーション(Hallucination:幻覚)」です。

「リサーチ業務を効率化しようとAIに市場調査を頼んだら、存在しない競合他社のデータをでっち上げられた」

「契約書の条文チェックを任せたら、架空の法律を根拠に修正を提案され、危うくそのままクライアントに送るところだった」

「社内マニュアルの検索ボットを作ったが、古い規定と新しい規定を勝手に混ぜ合わせて回答し、現場が混乱した」

これらは決して笑い話ではなく、実際に多くの現場で起きているトラブルです。生成AIは、私たちの業務を劇的に効率化する「魔法の杖」であると同時に、扱い方を間違えれば企業の信用を一瞬で崩壊させる「諸刃の剣」でもあります。

ハルシネーションは、単なる技術的なバグではありません。現在の生成AIの仕組み上、避けては通れない特性です。だからこそ、企業には「AIは嘘をつくものである」という前提に立った、冷静かつ戦略的な対策が求められます。

本記事では、生成AIのハルシネーション対策について、Google検索上位の最新知見や専門的な技術レポートを徹底的に分析。現場ですぐに使える「プロンプトエンジニアリング(指示出しの技術)」から、システム的な解決策である「RAG(検索拡張生成)」、そして企業を守るための「ガバナンス体制」まで、あらゆる角度からリスクを最小化するためのフレームワークを解説します。

この記事を読み終える頃には、あなたはハルシネーションという「幽霊」の正体を正しく理解し、それを手なずけるための具体的な武器を手にしているはずです。

生成AIの「もっともらしい嘘」に困っていませんか?ハルシネーションの正体と向き合う姿勢

敵を倒すには、まず敵を知ることから始めなければなりません。なぜ世界最高峰の頭脳を持つはずのAIが、平気で嘘をつくのでしょうか? その答えは、彼らの「思考の仕組み」そのものに隠されています。

なぜAIは自信満々に嘘をつくのか?確率論から見るメカニズム

私たちが普段利用しているChatGPTやClaude、Geminiといった大規模言語モデル(LLM)は、人間のように言葉の意味を深く理解して会話しているわけではありません。彼らが行っているのは、超高度な「確率計算」です。

LLMは、インターネット上の膨大なテキストデータを学習し、「ある単語の次に、どの単語が来る確率が高いか」という統計的なパターンを記憶しています。

例えば、「昔々、あるところに」という入力があれば、学習データに基づいて高い確率で「おじいさんとおばあさんが」という言葉を選び出します。「住んでいました」と続けば文章は完成です。

この仕組みは、一般的な会話や文章作成では素晴らしい力を発揮します。しかし、AIが学習していない未知の情報や、事実関係が複雑な問いを投げかけられた時、この「確率予測」が仇となります。

AIは「わからない」と沈黙する代わりに、学習データの中で文脈的に繋がりそうな言葉を確率的に選び出し、強引に文章を繋げようとします。

「日本の現在の首都は?」と聞かれれば「東京」と答えますが、「22世紀の日本の首都は?」と聞かれた時、AIは未来を知りません。しかし、「22世紀」「日本」「首都」という言葉に関連するSF小説や予測記事のパターンを確率的に組み合わせ、「ネオ東京です」と真顔で(自信満々のトーンで)答えてしまうことがあるのです。

これがハルシネーションの正体です。彼らに悪気はありません。ただ、「確率的に最も自然な文章」を作ろうと努力した結果、事実とは異なる「もっともらしい嘘」が生まれてしまうのです。

ハルシネーションは「バグ」ではなく「仕様」?ゼロにできない現実を知る

多くの企業担当者が、「ハルシネーションを起こさない完璧なAIモデルはどれか?」と探しています。しかし、残念ながら現時点では、ハルシネーション発生率が0%のモデルは存在しません。

これはソフトウェアの「バグ(不具合)」というよりは、現在のLLMアーキテクチャにおける「仕様(特性)」に近いものです。人間が記憶違いをするように、確率で言葉を紡ぐAIもまた、不正確さを内包しています。

もちろん、OpenAIやGoogleなどの開発企業は、強化学習(RLHF)などを通じてハルシネーションを減らす努力を続けていますが、そのリスクを完全に排除することは原理的に困難です。

したがって、企業が持つべきスタンスは、「ハルシネーションをゼロにする」という不可能な目標を掲げることではありません。「ハルシネーションは必ず起こるもの」という前提に立ち、

- 発生頻度を可能な限り下げる(予防)

- 発生しても人間が気づけるようにする(検知)

- 誤情報が業務上の実害に繋がらないようにする(被害最小化)

という、リスクマネジメントの視点を持つことです。

企業が恐れるべきは技術的ミスよりも「信用の失墜」と「法的リスク」

たった一つのハルシネーションが、企業経営に甚大なインパクトを与える可能性があります。

米国では実際に、弁護士がChatGPTを使って判例調査を行い、AIが捏造した「存在しない過去の判例」をそのまま裁判所に提出してしまった事例があります。結果、その弁護士は裁判官から厳しい制裁を受け、法律事務所としての信用は地に落ちました。

もしこれが、医療現場での診断支援AIだったらどうでしょうか? あるいは、金融機関の投資アドバイスAIだったら?

誤った情報に基づく意思決定は、損害賠償請求や法的ペナルティ、そして何年もかけて築き上げたブランドイメージの毀損に直結します。

ハルシネーション対策は、情報システム部門だけの技術的な課題ではありません。経営層がコミットすべき、コンプライアンスおよびリスク管理上の最重要課題なのです。

敵を知れば怖くない!ハルシネーションの2つのタイプと発生原因

「嘘」にも種類があります。ハルシネーションを効果的に防ぐためには、それがどのようなメカニズムで発生しているのか、タイプを見極める必要があります。学術的・実務的に、ハルシネーションは大きく2つのタイプに分類されます。

【内因性】参照データと矛盾してしまう「読み間違い」タイプ

内因性ハルシネーション(Intrinsic Hallucinations)とは、AIに特定の情報源(ドキュメントやニュース記事など)を与えて処理させた際に、その情報源の内容と矛盾する出力を生成してしまう現象です。

例えば、AIに長い決算資料を読み込ませ、「この会社の当期の利益を要約して」と指示したとします。元の資料には「営業利益は10億円」と書いてあるのに、AIが要約文の中で「営業利益は12億円と過去最高を記録し……」と出力してしまうようなケースです。

これは、AIが入力されたコンテキスト(文脈)情報を正しく捉えきれなかったり、情報量が多すぎて処理能力を超えたりした場合に発生します。いわば、AIによる「読み間違い」や「記憶の混同」です。

RAG(検索拡張生成)システムを導入している場合でも、検索してきたドキュメントの内容をAIが誤解釈すれば、この内因性ハルシネーションが発生します。

【外因性】知らないことを創作してしまう「知ったかぶり」タイプ

外因性ハルシネーション(Extrinsic Hallucinations)とは、与えられた情報源や学習データの中にそもそも答えが存在しないにもかかわらず、AIが事実に基づかない新しい情報を勝手に作り出してしまう現象です。

「弊社が開発中の極秘プロジェクトXについて教えて」と、まだ世に出ていない情報をChatGPTに聞いたとします。AIはそのプロジェクトを知りませんが、「プロジェクトXは、次世代の量子コンピューティング技術を活用した……」などと、それっぽい説明を創作し始めることがあります。

これは、AIが「わかりません」と答える代わりに、質問に含まれるキーワード(この場合は「プロジェクト」「開発」など)から連想される確率の高い言葉を繋ぎ合わせ、ユーザーを満足させようとするあまりに起こる「知ったかぶり」です。

一般的に「ハルシネーション」と言われてイメージされるのは、この創作型のケースが多いでしょう。

データ・技術・運用…どこに原因があるかを切り分ける視点

ハルシネーションが発生した際、闇雲に対策するのではなく、原因を以下の3つのレイヤーで切り分けることが解決への近道です。

- データ(Data)の要因

- 学習データや参照データが古い、誤っている、または偏っている。

- そもそも回答に必要な情報がデータセットに含まれていない。

- 対策:データのクリーニング、ナレッジベースの更新。

- 技術(Model/System)の要因

- 使用しているLLMの性能不足(パラメータ数が少ない、推論能力が低い)。

- RAGシステムにおける検索精度が低い(関係ないドキュメントを拾ってきている)。

- モデルのパラメータ設定(Temperatureなど)が高すぎて、創造性が高まりすぎている。

- 対策:上位モデルへの切り替え、検索アルゴリズムの改善、パラメータ調整。

- 運用(Prompt/Instruction)の要因

- ユーザーの指示(プロンプト)が曖昧で、AIに解釈の幅を与えすぎている。

- 「わからない場合はわからないと答えて」という制約条件を与えていない。

- 複雑なタスクを一度に処理させようとしている。

- 対策:プロンプトエンジニアリングの改善、タスクの分割。

特に3つ目の「運用(プロンプト)」は、追加コストをかけずに現場レベルですぐに実行できるため、最初に取り組むべき対策です。

リスクを最小化する戦略的フレームワーク「三層防御モデル」とは

サイバーセキュリティの世界に「多層防御」という考え方があるように、ハルシネーション対策も単一のアプローチでは不十分です。

本記事では、企業が導入すべき対策を体系化した「三層防御モデル」を提唱します。このフレームワークに沿って対策を講じることで、漏れのない堅牢なAI活用体制を構築できます。

単発の対策では防げない?多層的なアプローチが必要な理由

プロンプトを工夫するだけでは、AIモデル自体の知識不足は補えません。逆に、最新のRAGシステムを導入しても、使う人間が誤った使い方をすれば誤情報は防げません。

物理的な壁、センサー、警備員と、セキュリティを何重にも重ねるのと同じように、AIのリスクも異なる性質の壁で何重にもブロックする必要があります。

第一層:プロンプトエンジニアリング(現場ですぐできる戦術的防御)

目的: AIへの指示を最適化し、誤情報生成の「誘発」を防ぐ。

概要: ユーザー側でコントロール可能な最も手軽な対策です。指示の明確化、制約条件の付与、思考プロセスの誘導などを行い、AIが「確率的な当てずっぽう」を行う余地を狭めます。

コスト: 低(教育コストのみ)

即効性: 高

第二層:RAG・モデル最適化(システムによる技術的防御)

目的: 信頼できる外部知識を与え、AIを事実に「グラウンディング(根拠付け)」させる。

概要: AIの記憶のみに頼るのではなく、社内データベースや信頼できるWeb検索結果を参照させるシステム(RAG)を構築します。また、特定の専門分野においてはモデル自体を追加学習(ファインチューニング)させることも含まれます。

コスト: 中〜高(開発・運用コスト)

即効性: 中(導入に時間がかかる)

第三層:ガバナンス・HITL(組織による最終防衛ライン)

目的: 人間の目による監視と、組織的なルールでリスクを管理する。

概要: Human-in-the-Loop(HITL)と呼ばれる「人間による確認」をプロセスに組み込みます。また、ガイドラインの策定、利用ログの監査、責任の所在の明確化など、技術で防ぎきれなかったエラーが実害にならないための組織的な安全網を敷きます。

コスト: 中(人件費・管理コスト)

即効性: 高(ルール制定次第)

【第一層:プロンプト編】明日から使える!AIの暴走を防ぐ「6つの魔法の言葉」

それでは、第一層の防御策である「プロンプトエンジニアリング」から具体的に解説していきます。

プロンプト一つで、AIの回答精度は天と地ほど変わります。ここでは、ハルシネーション抑制に特に効果が高いとされる「6つの基本原則」を紹介します。これらは明日からすぐに、ChatGPTや社内AIで試せる実践的なテクニックです。

「わからない」と言える勇気を持たせる:確実性の担保

AIは基本的に「ユーザーの役に立ちたい」「質問に答えなければならない」という強いバイアス(傾向)を持っています。そのため、答えを知らなくても無理やりひねり出そうとします。

これを防ぐには、「わからなければ、わからないと言っていいんだよ」と許可を与え、同時に命令することが最も効果的です。

- × 悪いプロンプト例:

「2024年の日本の法改正について詳しく教えて」

(※AIが情報を知らなくても、創作して答えるリスクがある) - ◎ 良いプロンプト例(改善版):

「2024年の日本の法改正について教えてください。もし確実な情報がない場合や、あなたの知識範囲外である場合は、無理に回答を作成せず、正直に『わかりません』と答えてください。推測による回答は禁止します。」

この一文を加えるだけで、外因性ハルシネーション(知ったかぶり)の発生率は劇的に低下します。

「ソースを出して」とお願いする:情報の根拠・出典の明示化

AIが生成した情報が正しいかどうかを人間が検証するためには、「どこからその情報を得たのか」を知る必要があります。回答に必ずソース(出典)を添えるよう指示しましょう。

- ◎ プロンプト例:

「以下のテーマについてレポートを作成してください。記述するすべての事実情報について、その根拠となる情報源(URLやドキュメント名)を明記してください。根拠が不明な情報は含めないでください。」

出典が明記されていれば、リンクをクリックして事実確認ができます。逆に出典を出せない情報は「怪しい」と即座に判断でき、リスクを回避できます。

「順を追って考えて」と導く:Chain-of-Thought(思考の連鎖)

「Chain-of-Thought(思考の連鎖)」は、AI研究の中で発見された強力な手法です。いきなり答えを出させるのではなく、計算の過程や推論のステップを書かせることで、論理的な誤りを減らすことができます。

- × 悪いプロンプト例:

「この決算データの合計値を出し、前年比の成長率を計算して」 - ◎ 良いプロンプト例(CoT適用):

「この決算データの分析を行います。ステップ・バイ・ステップで考えてください。- まず、各部門の数値をリストアップしてください。

- 次に、それらを合計する計算式と過程を示してください。

- 最後に、前年比の成長率を計算し、結論を述べてください。」

思考過程を出力させることで、AI自身が途中で論理の矛盾に気づきやすくなるほか、人間が見た時に「どこで計算を間違えたか」が追跡可能になります。

「本文からそのまま引用して」と縛る:直接引用による改変防止

要約タスクなどで、AIが勝手な解釈を加えて文章を変えてしまうのを防ぐには、「直接引用」を強制するのが有効です。

- ◎ プロンプト例:

「以下の契約書を要約してください。特に重要と思われる条項については、原文を一言一句変更せず、そのまま『』で引用して記載してください。言い換えや要約は行わないでください。」

これにより、ニュアンスの変化や意図しない改変を防ぎ、原文の正確性を保ったまま情報を抽出できます。

「3回考えてみて」と慎重にさせる:複数実行によるクロスチェック

重要な意思決定に関わる質問の場合、AIに「自己検証」や「複数検討」をさせる手法も有効です。

- ◎ プロンプト例:

「このマーケティングプランのリスクを洗い出してください。同じ質問に対して3つの異なる視点から検討を行い、それぞれ回答を作成してください。その後、3つの回答を比較し、最も確実性が高いと思われる共通の結論をまとめてください。」

ハルシネーションはランダムに発生するため、3回とも同じ嘘をつく確率は低くなります。回答が割れた場合は「信頼度が低い」と判断できます。

「この資料以外は見ないで」と制限する:外部知識の遮断テクニック

社内規定やマニュアルに基づく回答作成など、外部の一般的な情報(インターネット上の古い情報など)が混ざると困るケースでは、参照範囲を厳密に限定します。

- ◎ プロンプト例:

「以下の###参考テキスト###の内容のみに基づいて、質問に回答してください。あなたの持っている外部知識や一般常識は一切使用しないでください。参考テキストに答えが書かれていない場合は、『提供された情報には記載がありません』と答えてください。」

これにより、AIの「知識」ではなく、目の前の「テキスト処理能力」だけを利用することになり、予期せぬ情報の混入を物理的(論理的)に遮断できます。

【第二層:技術・システム編】RAG(検索拡張生成)でAIを「優等生」に育てる

プロンプトエンジニアリングは強力ですが、あくまでAIが持っている知識の範囲内でしか機能しません。社内独自のデータや最新のニュースに基づいて正確に回答させるには、システムレベルでの対策、すなわち「RAG」の導入が不可欠です。

RAGの基本:社内データを「カンニングペーパー」として持たせる仕組み

RAG(Retrieval-Augmented Generation:検索拡張生成)とは、LLMに外部の知識ベース(データベース)を連携させ、回答生成時に必要な情報をリアルタイムで検索・参照させる技術アーキテクチャです。

試験に例えるなら、通常のChatGPTは「記憶だけを頼りに試験を受ける生徒」です。どれほど優秀でも、記憶していない問題や忘れてしまった問題には答えられず、適当に埋めてしまうことがあります。

一方、RAGを装備したAIは、「教科書や参考書の持ち込みを許可された生徒」です。質問されると、まず手元の参考書(社内データ)をパラパラとめくって該当箇所を探し(検索)、そこに書かれている内容を読みながら回答を作成(生成)します。

これにより、以下のメリットが生まれます。

- 最新情報への対応: データベースを更新すれば、AIの再学習なしで最新情報を反映できる。

- 根拠の明示: 「このドキュメントの○ページ目を参照しました」と提示できる。

- ハルシネーションの低減: 参照データに基づいて回答するため、根拠のない創作が減る。

成功の鍵はデータの質!ナレッジベースの鮮度と構造化の重要性

「RAGを導入すればハルシネーションはなくなる」と考えるのは早計です。RAGシステムにおいて最も重要なのは、AIでも検索エンジンでもなく、「参照させるデータの品質」です。

Garbage In, Garbage Out(ゴミを入れればゴミが出てくる)の原則はRAGでも健在です。

もし、参照させる社内マニュアルの中に「2020年版(旧)」と「2024年版(新)」が混在しており、ファイル名も整理されていなかったらどうなるでしょうか? AIは誤って古いマニュアルを参照し、堂々と古いルールを回答するでしょう。これはAIのミスではなく、データ管理(ナレッジマネジメント)のミスです。

RAGを成功させるためには、以下のデータ整備が必要です。

- 最新化: 古いデータ、重複したデータを除外・アーカイブする。

- 構造化: PDFやパワポの画像を、AIが読み取りやすいテキスト形式に変換する。

- メタデータ付与: 「作成日」「部署」「カテゴリ」などのタグを付け、検索精度を高める。

ハルシネーション対策の本質は、実は地道な「社内情報の整理整頓」にあるのです。

RAGでも防げないミスはどうする?内因性ハルシネーションへの対処法

RAGを使っても、「検索してきた文章をAIが読み間違える」という内因性ハルシネーションのリスクは残ります。これを防ぐための技術的なチューニングポイントがあります。

- チャンク(Chunk)の最適化:

ドキュメントを細切れにする際、適切な長さ(例:500文字など)に調整します。長すぎるとAIが情報を処理しきれず、短すぎると文脈が切れてしまいます。意味のまとまりごとに分割する工夫が必要です。 - リランキング(Re-ranking):

検索でヒットした上位の文章を、さらに別の高精度なモデルで「本当に関連性が高いか」並べ替える処理を挟みます。これにより、AIに渡す情報の純度を高めます。 - 引用箇所のハイライト:

回答の中に、参照した文章の該当箇所を明示的に引用させ、ユーザーが即座に原文を確認できるUI(ユーザーインターフェース)を設計します。

ファインチューニングとの使い分け:自社専用モデルを育てるべきタイミング

RAGとは別に、AIモデル自体に追加学習させる「ファインチューニング」という手法があります。

「RAGとファインチューニング、どっちがいいの?」という議論がありますが、これらは対立するものではなく、補完し合うものです。

- RAGが適しているケース:

- 情報が頻繁に更新される(ニュース、在庫情報、人事異動など)。

- 正確な事実の引用が求められる。

- コストを抑えたい。

- ファインチューニングが適しているケース:

- 業界特有の専門用語や言い回しを理解させたい(医療、法律、特許など)。

- 特定のフォーマットや文体で出力させたい。

- モデルに新しい「スキル」や「思考パターン」を覚えさせたい。

最高の精度を目指すなら、「専門知識をファインチューニングで学習したモデル」に、「RAGで最新の社内データを参照させる」というハイブリッド構成が理想的です。

【第二層:モデル選定編】ChatGPT・Claude・Gemini…モデルごとの「癖」を理解する

ハルシネーションのリスクは、使用するAIモデルによっても異なります。各社のフラッグシップモデルにはそれぞれ「性格」や「癖」があります。これを理解し、適材適所で使い分けることが重要です。

創造性重視か、正確性重視か?業務ごとのAI適材適所論

2024年〜2025年時点での主要モデルの傾向を概観します(※技術は急速に変化するため、常に最新情報の確認が必要です)。

- OpenAI / GPT-4o (GPT-4 Turbo):

万能型で非常に高い知能を持ちます。指示への追従性も高いですが、やや「サービス精神」が旺盛で、話を盛り上げようとしてハルシネーションを起こすことがあります。アイデア出しやクリエイティブな文章作成に向いています。 - Anthropic / Claude 3.5 Sonnet (Claude 3 Opus):

「Helpful, Harmless, Honest(有益、無害、正直)」を憲法として開発されており、安全性と正確性を重視する傾向があります。わからないことは正直にわからないと言う傾向が強く、長文の読み込み能力(コンテキストウィンドウ)も非常に大きいため、RAGや大量のドキュメント分析、法務チェックなどに適していると評価されています。 - Google / Gemini 1.5 Pro:

Google検索との統合が強力で、リアルタイムのWeb情報収集能力に長けています。また、YouTube動画や音声データの解析も得意です。ただし、検索結果のバイアスに影響されることもあるため、ソースの確認は必須です。

「とにかくChatGPT」と一択にするのではなく、「正確性が命の契約書チェックはClaudeで」「最新ニュースのまとめはGeminiで」といった使い分け戦略が、リスク分散に繋がります。

モデルを単体で信じない!複数AIによる「セカンドオピニオン」体制

人間も一人だけの意見だと偏るように、AIも単一モデルだとバイアスがかかります。そこでおすすめなのが「マルチLLMアプローチ(セカンドオピニオン体制)」です。

例えば、GPT-4oにブログ記事を書かせたとします。その原稿を、今度はClaude 3.5に読み込ませ、「この記事の中に事実誤認や論理的な飛躍がないかチェックして」と指示します。

異なる開発思想、異なる学習データで作られたAI同士を戦わせる(クロスチェックさせる)ことで、人間が気づきにくい微細なハルシネーションを炙り出すことができます。最近では、このプロセスを自動化する「LLM-as-a-Judge(審査員としてのLLM)」という手法も開発現場で普及し始めています。

【第三層:組織・ガバナンス編】最後はやっぱり「人」!Human-in-the-Loopの徹底

プロンプトを磨き、RAGを導入し、最強のモデルを選んだとしても、リスクはゼロになりません。最後の砦(ラスト・ワンマイル)を守るのは、やはり人間と組織の仕組みです。

AI任せにしない覚悟:ファクトチェックを業務プロセスに組み込む

「Human-in-the-Loop(HITL:人間参加型)」とは、AIシステムの中に必ず人間の判断プロセスを介在させる設計思想です。

生成AIの業務利用において、これを「努力目標」ではなく「必須の業務フロー」として組み込む必要があります。

具体的には、以下のようなルールを設けます。

- AIが生成した対外向け文章(メール、プレスリリース、SNS投稿)は、送信前に必ず人間が目視で確認する。

- AIによるデータ分析結果を経営会議で使用する場合、元データとの突合チェックを担当者が行うことを義務付ける。

- コード生成AIが書いたプログラムは、必ずセキュリティテストを通してから実装する。

「AIがやったので気づきませんでした」という言い訳は、ビジネスの現場では通用しません。AIはあくまで「ドラフト(下書き)作成係」であり、最終的な「承認印」を押すのは人間であるという意識改革が必要です。

誰が責任を取るのか?「AI使用者・確認者・承認者」の役割定義

ハルシネーションによって損害が発生した場合、誰が責任を負うのでしょうか?

AIベンダー(OpenAIやMicrosoftなど)の利用規約には、通常「出力結果の正確性は保証しない」「利用に伴うリスクはユーザーが負う」といった免責条項が含まれています。つまり、ベンダーに責任を転嫁することは基本的にできません。

企業は社内規定で明確な役割分担を定義すべきです。

- 使用者(User): 適切なプロンプトを入力し、出力結果の一次確認を行う責任。

- 管理者(Manager): 部下がAIを適切に使用しているか監督し、重要な成果物の最終チェックを行う責任。

- AI統括責任者(AI Officer): 全社のガイドラインを策定し、安全なAIツールを選定・提供する責任。

「誰の責任かわからない」状態が一番危険です。責任の所在を明確にすることで、各人のチェックに対する真剣度が高まります。

「なんとなく使う」を防ぐ!社内ガイドラインと禁止事項の策定

全従業員向けの「生成AI利用ガイドライン」を策定し、周知徹底します。ハルシネーション対策に関連する項目としては、以下のような内容を盛り込みます。

- 禁止事項:

- 裏付けの取れていないAI生成情報を、ファクトチェックなしに外部へ公開すること。

- 人命に関わる医療判断や、法的な最終判断をAIのみに行わせること。

- 機密情報や個人情報を、学習データとして利用される設定のまま入力すること(これは情報漏洩対策ですが、ハルシネーション防止の観点からも、不正確な外部学習データ汚染を防ぐ意味で重要です)。

- 推奨事項:

- 出力結果には必ず「AIによって生成された可能性がある」旨の注釈を入れること(透明性の確保)。

- 重要な情報については、必ず信頼できる一次情報(公的機関のサイトなど)で裏取りを行うこと。

万が一のトラブルに備えて:監査ログの保存と説明責任(XAI)

事故が起きた後のことも考えましょう。

金融機関や公的機関では特に重要ですが、「いつ、誰が、どんなプロンプトを入力し、AIがどう答えたか」という全ログ(証跡)を保存しておく必要があります。

もし誤情報によって顧客とトラブルになった際、ログが残っていれば、「AIが突発的に誤作動を起こしたのか」、それとも「社員が誘導尋問のようなプロンプトを入力したのか」を検証できます。原因が特定できれば、再発防止策を打てますし、説明責任を果たすこともできます。

また、AIの判断根拠を説明可能にする「XAI(Explainable AI:説明可能なAI)」の研究も進んでいます。RAGにおける参照元の提示機能などは、このXAIの一種と言えます。ブラックボックス化を防ぎ、プロセスを透明化することが、組織の信頼を守ります。

業界別に見るハルシネーション対策の最前線と注意点

ハルシネーションのリスク許容度は、業界によって全く異なります。クリエイティブ業界なら「面白い嘘」がアイデアになることもありますが、医療業界では命取りです。主要3業界の対策ポイントを整理します。

【法務・契約】存在しない判例・法令の引用を防ぐ鉄壁の確認フロー

リスク: 架空の法令、判例、条文の捏造。契約書の条項漏れや矛盾。

対策:

- 専用RAGの構築: 一般的なChatGPTではなく、信頼できる法律判例データベース(WestlawやLexisNexis、自社の過去契約書DBなど)のみを参照する専用のリーガルテックツールを導入する。

- リンク参照の徹底: 回答には必ず条文番号と、データベースへのリンクを付けさせる。

- 専門家の介入: AIはあくまで「リサーチアシスタント」と位置づけ、最終的な法的見解の作成は必ず弁護士や法務担当者が行う。

【医療・ヘルスケア】命に関わる誤情報を防ぐ専門家監修と利用制限

リスク: 誤った診断、不適切な薬剤の推奨、論文データの改変。

対策:

- 利用範囲の厳格な制限: 診断や治療方針の決定に汎用LLMを使用することを原則禁止する。使用は「論文の要約」「患者向け説明資料の草案作成」「事務作業」などに限定する。

- 医療特化モデルの利用: Med-PaLMなどの医療知識を追加学習・調整されたモデルを採用する。

- 医師によるダブルチェック: AIのアウトプットは、必ず医師や薬剤師が内容を確認し、署名した上で使用するフローを確立する。

【金融・マーケット】数字の誤りとコンプライアンス違反を防ぐ監査体制

リスク: 決算数値の誤り、架空の市場データの生成、不適切な投資助言による金融商品取引法違反。

対策:

- 数値リテラシーの付与: LLMは計算が苦手であることを理解し、計算処理はPythonコードを実行させる機能(Advanced Data Analysisなど)を使って行わせる。

- 監査ログの保存: すべての対話ログをコンプライアンス部門が監査できる状態で7年以上保存する。

- 免責事項の明示: 顧客向けチャットボットの場合、「AIの回答は参考情報であり、投資勧誘を目的とするものではありません」といった免責文言を画面上の目立つ場所に常時表示する。

生成AI導入のロードマップ:安全な運用のためのステップバイステップ

ここまで読んで、「やることが多すぎて何から手をつければいいかわからない」と感じた方もいるかもしれません。

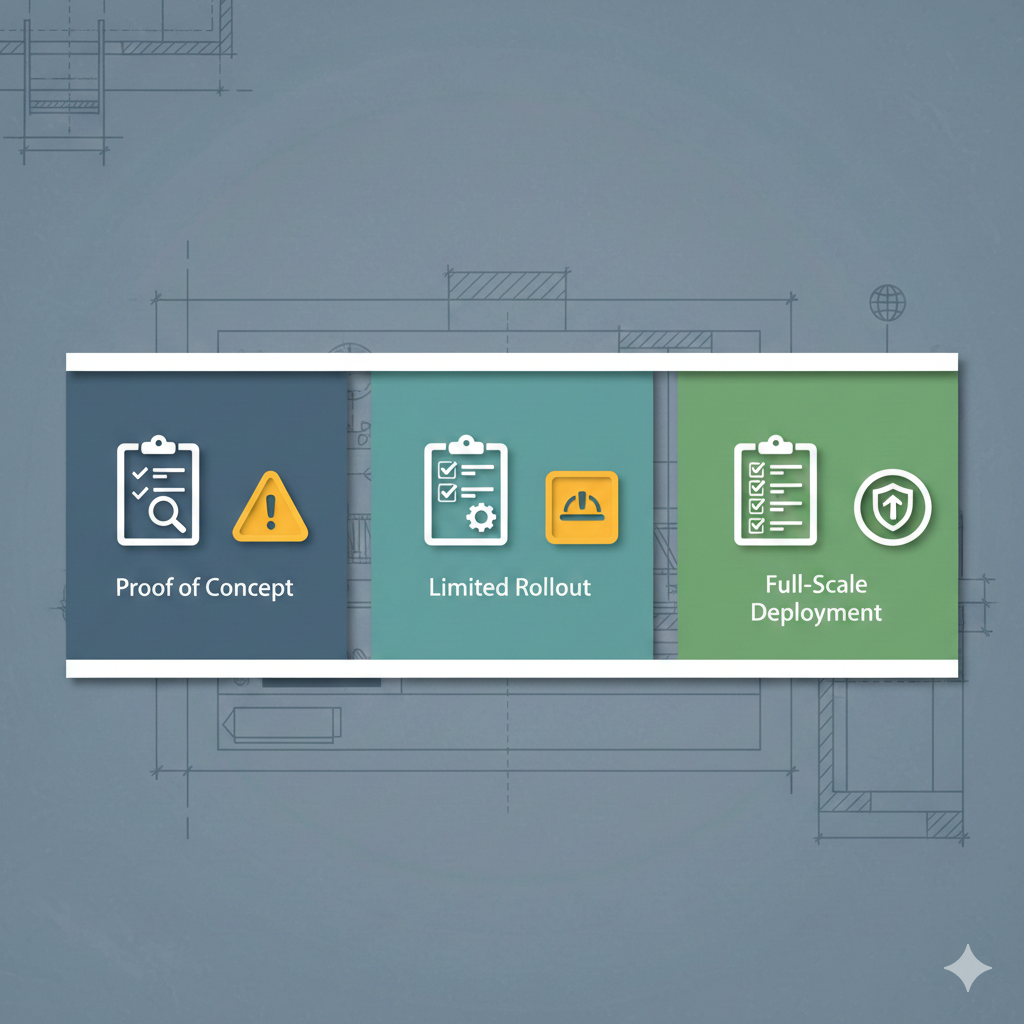

いきなり完璧な要塞を作る必要はありません。以下の3つのフェーズで段階的に対策レベルを引き上げていくことをお勧めします。

フェーズ1:PoC(概念実証)でのリスク洗い出しとプロンプト習熟

期間目安: 1〜3ヶ月

対象: 一部のITリテラシーが高いメンバー、DX推進チーム

アクション:

- セキュリティが確保された環境で生成AIを導入する。

- 実際の業務でAIを使い倒し、「どんな嘘をつくか」「どんな指示だと間違えるか」を実験する。

- 自社業務に特化した「効果的なプロンプト集(テンプレート)」を作成し、ノウハウを蓄積する。

- この段階では、重要な意思決定には使用しない。

フェーズ2:特定部署でのRAG導入とガイドラインの暫定運用

期間目安: 3〜6ヶ月

対象: 法務、カスタマーサポート、開発など特定の部署

アクション:

- 特定業務向けのRAGシステムをパイロット導入する(例:社内ヘルプデスク)。

- 利用ガイドライン(β版)を策定し、Human-in-the-Loopのフローを試行する。

- ハルシネーションが発生した際の報告ルート(インシデント対応フロー)を整備する。

- 参照させる社内データの整備(クリーニング)を集中的に行う。

フェーズ3:全社展開と継続的なモニタリング・教育体制の構築

期間目安: 6ヶ月以降〜

対象: 全社員

アクション:

- 全社員向けの研修を実施し、プロンプトエンジニアリングとリスク管理の基礎を教育する。

- 各部署に「AI推進リーダー」を配置し、現場レベルでの利用状況をモニタリングする。

- 定期的にAIモデルを最新版にアップデートし、RAGの検索精度をチューニングする。

- AI活用事例とヒヤリハット事例(失敗事例)を全社で共有し、組織全体のAIリテラシーを底上げする。

まとめ:ハルシネーションと上手に付き合い、AIを最強のパートナーにするために

「完璧」ではなく「被害最小化」を目指すレジリエンス思考

AIのハルシネーション対策において最も重要なマインドセット、それは「潔癖症にならないこと」です。

「一度でも嘘をついたら、そのAIは使い物にならない」と切り捨ててしまえば、企業は競争力を失います。人間だってミスをしますし、記憶違いもします。それでも私たちは、チェック体制を作ったり、ダブルチェックをしたりして、ミスが大きな事故にならないように工夫しながら仕事を回しています。

AIに対しても同じです。「嘘をつくかもしれない」という前提で、嘘をつかれても業務が破綻しないような「レジリエンス(回復力・強靭性)」のあるプロセスを設計すること。これこそが、賢いAI活用戦略です。

技術は進化するが、人間の「確認する目」は常に必要である

技術の進歩は速いです。今後数年で、AIのハルシネーション率はさらに低下し、ファクトチェックを自動で行うAIも登場するでしょう。

しかし、どれほどAIが進化しても、最終的な「価値判断」と「責任」をAIに譲り渡してはいけません。

「この情報は正しいか?」「この提案は倫理的に問題ないか?」「この文章はお客様の心に響くか?」

そう問いかけ、最後にGoサインを出すのは、常に人間の役割です。

リスクを恐れすぎず、正しく怖がってイノベーションを加速させよう

ハルシネーションは怖いものです。しかし、正体不明の幽霊として恐れるのではなく、メカニズムが解明された技術的な課題として「正しく怖がる」ことができれば、対策は十分に可能です。

プロンプトという「言葉の技術」、RAGという「システムの技術」、そしてガバナンスという「組織の技術」。この三層の防御壁を築き上げた企業だけが、生成AIという強力なエンジンを全開にして、ビジネスの未踏領域へと加速していけるのです。

さあ、まずは手元のAIに、「わからない時はわからないと言ってね」と話しかけるところから始めてみませんか? それが、安全で信頼できるAIパートナーシップへの第一歩です。