皆さん、こんにちは。今日のテーマは、法務部門の皆さんにとって、もはや避けては通れない「生成AIによる契約レビュー」についてです。AIが進化し、私たちの日常業務に浸透していく中で、「契約レビュー」という法務のコア業務にもその波が押し寄せています。

「AIって便利そうだけど、うちの会社で使うのはちょっと…」「情報漏洩とか、責任問題とか、心配なことがいっぱいあるんだけど、どうすればいいの?」

そんな疑問や不安を抱えている方も多いのではないでしょうか?でもご安心ください!この記事では、生成AIを契約レビューに導入する際の「最重要注意点」と、それらのリスクをどうやって「ガバナンス」していくのかを、具体的に、そして少し親しみやすいトーンで徹底解説していきます。

AIは単なるツールではありません。正しく理解し、適切に活用すれば、法務部門の生産性を劇的に向上させ、より戦略的な業務に集中できる時間を生み出す、強力なパートナーになり得ます。さあ、一緒に法務とAIの未来を覗いてみましょう。

エグゼクティブ・サマリー:生成AI契約レビューの最重要注意点とリスク

まずは、生成AI契約レビューを導入する上で、法務部門の皆さんが「これだけは絶対に押さえておきたい!」というポイントを、ぎゅっと凝縮してお伝えします。

生成AI契約レビューがもたらす革新と潜在リスクの概要

生成AI、特に大規模言語モデル(LLM)は、契約レビューの風景を根底から変える可能性を秘めています。想像してみてください。これまで何時間もかかっていた契約書の読み込み、リスク箇所の特定、修正案の提案といった作業が、わずか数分で完了するかもしれません。これは、法務部門が単なる「コストセンター」ではなく、企業価値を高める「戦略的パートナー」へと変貌を遂げる大きなチャンスです。

革新のポイント:

- 時間短縮と効率化: 定型的な契約書のレビュー時間を大幅に削減し、法務担当者はより複雑な案件や戦略的業務に集中できます。

- 品質の均一化と向上: AIが統一された基準でレビューを行うことで、レビューの品質が安定し、ヒューマンエラーのリスクを低減できます。

- ナレッジの蓄積と活用: AIがレビュープロセスを通じて学習することで、過去の知見やノウハウが組織全体で共有されやすくなります。

しかし、どんな強力なツールにも裏側があります。生成AIには、その恩恵と同等か、場合によってはそれ以上の「潜在リスク」が潜んでいることを理解しておく必要があります。

潜在リスクの概要:

- 情報漏洩・機密保持違反: 契約書には企業の機密情報が山ほど含まれています。AIにそれを学習させる際や、AIが生成した情報が外部に漏れるリスクは常に考慮すべきです。

- ハルシネーション(AIの嘘): AIがもっともらしいが事実ではない情報を生成してしまう現象です。契約レビューにおいて、AIが誤った法的解釈や存在しない条項を提示した場合、深刻な問題に発展する可能性があります。

- 法的責任の所在: AIがレビューした結果、問題が生じた場合に、誰がその責任を負うのか?AIツールベンダーなのか、それとも利用した企業なのか?この線引きは非常に重要です。

- バイアスと公平性: AIは学習データに基づいて判断を行います。もし学習データに偏りがあれば、AIのレビュー結果も特定のバイアスに影響され、公平性を欠く可能性があります。

これらのリスクを事前に把握し、適切な対策を講じることが、生成AIを安全かつ効果的に導入するための第一歩となります。

法務部門が直ちに取り組むべき最重要注意点(リスク)

さて、それでは具体的に、法務部門が「今すぐ」取り組むべき最重要注意点とは何でしょうか?これらを軽視すると、後々大きなトラブルに発展する可能性があるので、ぜひ頭に入れておいてくださいね。

情報セキュリティと機密保持の徹底:

絶対条件です! 契約書の内容が外部に漏洩することは、企業の信用失墜や損害賠償に直結します。AIツールを選定する際は、そのツールのセキュリティレベル、データの保存場所、暗号化の方法などを徹底的に確認する必要があります。特に、自社の機密情報をクラウドベースのAIサービスにアップロードする際には、そのリスクを十分に理解し、適切な契約(NDA等)を締結することが不可欠です。

AI出力の「鵜呑み禁止」と「人間の最終判断」の原則:

AIはあくまでサポートツールです。その出力は、必ず人間の法務担当者が最終確認し、責任を持って判断するという原則を絶対に守ってください。AIが提示する修正案やリスク評価が常に正しいとは限りません。「AIが言ったから大丈夫」という安易な思考は、重大な見落としや誤った判断を招く最大の原因となります。

AIの「学習データ」と「著作権」への意識:

皆さんがAIに読み込ませる契約書が、AIの学習データとしてどのように利用されるのかを明確に理解する必要があります。もしAIが自社の機密情報を含む契約書を学習し、それが他社への回答に利用されるようなことがあれば、大問題です。また、AIが生成した文章が、既存の著作物と酷似している場合の著作権侵害リスクも考慮に入れる必要があります。

導入前の「リスクアセスメント」と「ガイドライン策定」:

「なんとなく便利そうだから導入してみよう」はNGです。導入前に、自社の業務プロセスにおいてどのようなリスクが発生し得るのかを具体的に洗い出し、そのリスクをどう低減するかを検討する「リスクアセスメント」を必ず実施してください。そして、その結果に基づいて、AI利用に関する明確な社内ガイドラインを策定し、全従業員に周知徹底することが不可欠です。

これらの注意点を踏まえずに生成AIを導入することは、羅針盤を持たずに荒波の海に漕ぎ出すようなものです。まずはこれらの点をしっかりと押さえ、その上で次のステップへと進んでいきましょう。

法務部門における生成AI契約レビューの基本構造と注意すべき介入点

生成AIを契約レビューに組み込むにあたって、私たちの業務フローのどこにAIを導入するのが効果的で、どこに注意すべき点があるのかを具体的に見ていきましょう。

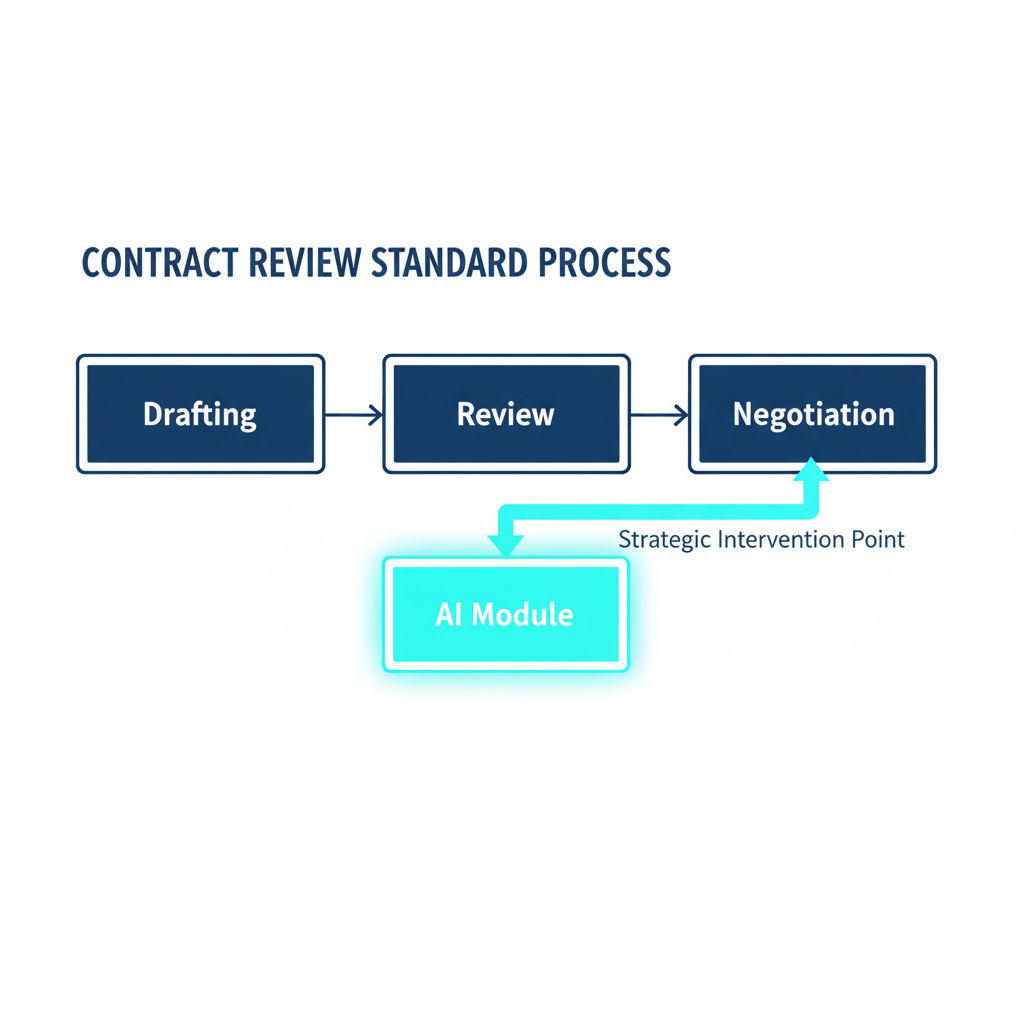

契約レビューの標準プロセスと生成AIの戦略的介入点

まずは、一般的な契約レビューのプロセスを整理し、生成AIがどこでその力を発揮できるかを確認します。

契約書受領・初期確認:外部から契約書を受け取り、種類や相手方、適用される法律などを確認するフェーズです。

AI介入点:

- 種類判別: AIが契約書のタイトルや内容から、売買契約、業務委託契約、秘密保持契約などの種類を自動で判別します。

- 条項抽出: 主要な条項(当事者、目的、期間、準拠法など)を自動抽出し、概要を提示します。

- 注意点: AIの判別はあくまで参考であり、最終的な分類は人間が行う必要があります。特に、複合的な契約の場合、AIの判断が難しいケースもあります。

ドラフトチェック・リスク評価:契約書の条項一つ一つを読み込み、自社にとってのリスクや不利益な条項がないかを確認し、修正案を検討する最も時間のかかるフェーズです。

AI介入点:

- リスク条項の特定: 過去の判例や自社のリスクポリシーに基づき、AIがリスクの高い条項(例:損害賠償上限なし、過度な免責条項、競業避止義務など)をハイライト表示し、その理由や関連する過去事例を提示します。

- 抜け漏れの検出: 標準的な契約書テンプレートと比較し、必要な条項の欠落や、矛盾する条項がないかを検出します。

- 修正案の提案: 特定のリスク条項に対して、自社の標準的な修正案や代替案を自動生成します。

- 注意点: AIは「過去のデータ」に基づいて判断するため、新たな法改正や業界慣行の変化には追随しきれない場合があります。また、契約の背景や当事者間の力関係といった「コンテクスト」をAIが完全に理解することは困難です。必ず人間の目による最終確認が必須です。

交渉・修正:相手方との交渉を通じて、契約条項の修正を行うフェーズです。

AI介入点:

- 交渉履歴の整理: 契約書のバージョン管理と修正履歴を自動で追跡し、変更点を明確にします。

- 代替案の迅速な生成: 交渉中に生じた論点に対し、その場で複数の代替案をAIに生成させることで、交渉をスムーズに進める手助けができます。

- 注意点: 交渉は人間同士のコミュニケーションであり、AIが直接交渉を行うことはできません。あくまで交渉材料の準備や情報整理のサポート役として活用すべきです。

最終確認・締結:修正が完了した契約書を最終確認し、締結に至るフェーズです。

AI介入点:

- 最終版の整合性チェック: 複数回の修正を経て、最終版に誤字脱字、参照条項の不整合、定義の不一致などがないかを最終的にチェックします。

- 注意点: 最終確認こそ、人間の責任が最も問われる場面です。AIがどれだけ優秀でも、最後の「よし」は人間が言うべきです。

このように、生成AIは契約レビューの多くのプロセスに戦略的に介入し、効率化と品質向上に貢献できます。しかし、その介入の「注意点」は常に「人間による最終確認」と「コンテクスト理解の限界」にあることを忘れてはいけません。

AI活用の類型と外部依頼モデルにおける注意点

生成AIを契約レビューに活用する際、大きく分けていくつかの類型があります。自社がどの類型でAIを導入するかによって、注意すべき点が異なります。

自社開発・オンプレミス型AI:自社でAIシステムを開発し、自社のサーバー内で運用するモデルです。

- メリット: 情報セキュリティの管理が最も厳格に行え、カスタマイズの自由度が高いです。

- 注意点: 開発・運用コストが非常に高く、専門的なAIエンジニアやデータサイエンティストが必要です。中小企業には現実的ではない場合が多いでしょう。

SaaS型AI契約レビューツール(クラウド利用型):

外部ベンダーが提供するAI契約レビューサービスを、インターネット経由で利用するモデルです。現在、多くの法務テック企業がこの形態のサービスを提供しています。

メリット: 低コストで導入でき、専門知識がなくてもすぐに利用開始できます。ベンダーがシステムのメンテナンスやアップデートを行います。

注意点(最重要!):

- データ保護とプライバシー: 最も懸念されるのが、自社の機密情報(契約書データ)がベンダーのサーバーに保存されることです。ベンダーがどのようなセキュリティ対策を講じているのか、データはどこに保存されるのか、第三者に開示されるリスクはないのか、学習データとして利用される可能性はあるのかを契約締結前に徹底的に確認する必要があります。

- SLA(サービスレベルアグリーメント): サービスが安定して提供されるか、ダウンタイムはどうか、サポート体制はどうかなどを明確にしたSLAを確認することが重要です。

- ベンダーの信頼性: ベンダーの過去の実績、セキュリティ認証の有無(ISO 27001など)、事業継続性などを評価する必要があります。

- カスタマイズ性: 自社の契約書フォーマットやリスクポリシーに合わせたカスタマイズが可能かどうかも確認ポイントです。

LLMをAPIで利用し、自社で連携・開発するモデル:

OpenAIのGPTシリーズのような大規模言語モデルをAPI経由で利用し、自社で独自のインターフェースや追加機能を開発するモデルです。

- メリット: SaaS型よりも柔軟なカスタマイズが可能で、自社の業務フローに合わせたシステムを構築しやすいです。

- 注意点:データ連携とセキュリティ: API連携時のデータ暗号化、アクセス制御、ログ管理など、セキュリティ設計を自社で適切に行う必要があります。

- プロンプトエンジニアリング: LLMの性能を最大限に引き出すためには、適切な「プロンプト」(AIへの指示文)を設計するスキルが求められます。

- 費用管理: API利用は従量課金制が多いため、利用量に応じたコスト管理が重要になります。

どの類型を選択するにしても、最も重要なのは「自社の情報セキュリティポリシーと整合しているか」「法的リスクを適切に管理できるか」という視点です。特にSaaS型やAPI利用型の場合、外部ベンダーとの契約内容が、自社のリスクガバナンスの要となります。 曖昧なまま導入を進めることは絶対に避けてくださいね。

生成AI契約レビューにおける法的な「注意点」とリスク深掘り:LLM固有の課題

生成AIを契約レビューに活用する際、単なる効率化だけでなく、法務部門として特に深く掘り下げて考えるべき「法的注意点」と、大規模言語モデル(LLM)固有の課題について見ていきましょう。ここを理解せずに進むと、思わぬ落とし穴にはまる可能性があります。

情報セキュリティと機密保持の根源的注意点

「情報は企業の命」と言われるように、契約書に含まれる情報はまさに企業の機密の塊です。生成AIを導入する際、この情報セキュリティと機密保持は最も根源的かつ重要な注意点となります。

データ保存場所と暗号化:

- 注意点: クラウドベースのAIサービスを利用する場合、契約書データがどこに保存されるのか(国内か海外か)、どのように暗号化されるのかを明確に確認してください。特に海外のサーバーに保存される場合、現地の法規制(例:米国クラウド法など)によって、外国政府からの情報開示請求に応じなければならないリスクも考慮に入れる必要があります。

- 対策: 可能であれば国内にサーバーを持つベンダーを選定するか、E2EE(End-to-End Encryption)など、高度な暗号化技術が導入されていることを確認しましょう。

学習データへの利用:

- 注意点: 多くのLLMは、ユーザーが入力したデータをモデルの性能向上のために学習データとして利用する場合があります。もし自社の機密情報を含む契約書がAIの学習データとして利用され、それが他社のユーザーへの回答に影響を与えるようなことがあれば、機密保持義務違反となる可能性があります。

- 対策: AIツールベンダーとの契約において、「入力データは学習に利用しない」という条項が明記されているか、または「学習利用をオプトアウトできる」オプションがあるかを確認し、必ずオプトアウト設定を行ってください。

アクセス管理と認証:

- 注意点: AIツールへのアクセス権限が適切に管理されているか、多要素認証(MFA)が導入されているかなど、不正アクセスを防ぐための対策が講じられているか確認が必要です。また、退職者のアカウントが速やかに無効化される運用体制も重要です。

- 対策: 社内ガイドラインで利用者を限定し、厳格なアクセス権限管理を徹底します。

情報漏洩時の対応プロトコル:

- 注意点: 万が一、AIツールを通じて情報漏洩が発生した場合に、ベンダーがどのような対応を行うのか(報告義務、損害賠償、再発防止策など)を事前に確認し、契約書に明記させておく必要があります。

- 対策: 契約書に、情報漏洩時のベンダーの責任範囲、報告義務、対応プロセスなどを具体的に盛り込みましょう。

「AIは便利だから」と安易に導入し、情報セキュリティ対策を疎かにすると、取り返しのつかない事態を招く可能性があります。導入検討の初期段階で、これらの情報セキュリティと機密保持に関するリスクを徹底的に洗い出し、適切な対策を講じることが、法務部門の責務です。

AI出力の信頼性・正確性に関する注意点と法的責任の所在

AIが生成する情報は完璧ではありません。特に法務分野において、AI出力の信頼性と正確性は死活問題であり、万が一誤りがあった場合の「法的責任」が誰に帰属するのかは、非常にデリケートな問題です。

ハルシネーション(Hallucination)のリスク:

- 注意点: LLMは、あたかも事実であるかのように、もっともらしいが虚偽の情報を生成する「ハルシネーション」を起こすことがあります。例えば、「〇〇法第X条に基づいて」と、存在しない法令や条文を引用したり、実在しない判例を提示したりする可能性があります。契約レビューでこれが発生すれば、法的根拠のない修正案を提示したり、重大なリスクを見落とすことにつながります。

- 対策: AIの出力はあくまで「参考情報」として扱い、必ず人間の法務担当者がその正確性を検証する「ヒューマン・イン・ザ・ループ(HITL)」の体制を徹底してください。AIが参照した情報源を明示する機能があれば、それを活用し、一次情報に当たって確認する習慣をつけましょう。

知識の鮮度と学習データのバイアス:

- 注意点: LLMの知識は、学習データを取得した時点のものであり、常に最新の法改正や判例を反映しているとは限りません。また、学習データに特定の偏りがある場合、特定の地域や業界、文化に特化した解釈や、差別的な表現を生成してしまうリスクもあります。

- 対策: AIの知識がいつ時点のものであるか、どのようなデータで学習されているかをベンダーに確認しましょう。常に最新の情報にアクセスする必要がある場合は、追加学習やアップデートの頻度を確認し、自社の法務担当者が最新情報を補完する運用を徹底します。

法的責任の所在:

- 注意点: AIが誤ったレビュー結果を提示し、それに基づいて契約を締結した結果、企業に損害が生じた場合、その法的責任は誰が負うのでしょうか?AIツールを提供したベンダーなのか、それともAIツールを利用して最終判断を下した企業(法務担当者)なのか?これはまだ明確な判例が少なく、非常に難しい問題です。

- 対策: 現状では、「AIはあくまでサポートツールであり、最終的な判断と責任は人間が負う」という原則を社内で徹底することが最も重要です。AIツールベンダーとの契約では、ベンダー側の責任範囲(例:ツールのバグやセキュリティ欠陥による損害)と、ユーザー側の責任範囲(例:AI出力の最終確認義務を怠ったことによる損害)を明確に定めておくべきです。ただし、ベンダー側が「AIの出力は保証しない」という条項を入れている場合が多いため、実質的に利用企業が責任を負うケースが多いと想定されます。

AIの信頼性は、今後の技術進化とともに向上していくでしょうが、現時点では「疑ってかかる」姿勢が法務部門には不可欠です。AIの限界を理解し、人間の判断と責任を明確にすることで、法的リスクを最小限に抑えることができます。

著作権・学習データに関する法的課題と注意点

生成AIと著作権の問題は、今最もホットで複雑な法的課題の一つです。契約レビューにおいて、学習データとAIが生成する出力の両面から、著作権に関する注意点を見ていきましょう。

学習データの適法性:

- 注意点: AIは膨大なテキストデータから学習することで、人間のような文章生成能力を獲得します。この学習データの中に、著作権で保護されたコンテンツが多数含まれている場合、その学習行為が著作権侵害にあたるのではないかという議論があります。多くのAIベンダーは、フェアユースや情報解析を目的とした利用として適法性を主張していますが、これに対する法的な見解は国や地域によって異なり、まだ確定していません。

- 対策: AIツールベンダーに対し、学習データの情報源や著作権処理の状況について確認することが重要です。特に、機密情報が含まれる契約書をAIに学習させる場合は、それが他社の著作権を侵害しないか、また自社の著作権が適切に保護されるかを検討する必要があります。

AI生成物の著作権:

- 注意点: AIが生成した契約書ドラフトや修正案に著作権は発生するのでしょうか?もし発生するとすれば、その著作権は誰に帰属するのでしょうか(AI開発者、AI利用者、AI自体?)?日本の現行法では、著作権は「思想又は感情を創作的に表現したもの」に発生するとされており、人間以外の創作物には原則として著作権は認められていません。しかし、AIが生成したものが人間の創作性を補助する形で利用された場合など、複雑なケースも考えられます。

- 対策: 現時点では、AIが生成した成果物そのものに著作権が認められる可能性は低いと考えられます。しかし、AIの出力をもとに人間が加筆修正し、独自の創作性を加えた場合は、その部分について人間の著作権が発生すると解釈される可能性が高いです。法務部門としては、AIの出力をそのまま利用するのではなく、必ず人間が確認・修正・追記を行うことで、著作権保護の観点からも安全性を高める運用を徹底すべきです。

類似性・盗用リスク:

- 注意点: AIは学習したデータから文章を生成するため、既存の契約書テンプレートや他社の契約書と酷似した条項や表現を生成してしまうリスクがあります。これが「盗用」と見なされると、著作権侵害の法的責任を問われる可能性があります。

- 対策: AIが生成した文章については、既存の契約書や公開されている文書との類似性をチェックするツールを併用するなどして、盗用リスクを最小限に抑える努力が必要です。また、AIが参照した情報源を追跡し、オリジナリティを確保するための修正を加えることが重要です。

著作権に関する法的課題は、生成AIの進化とともに今後も議論が深まっていく分野です。現時点では、リスクを避けるために「AIは補助ツールであり、最終的な創作性と責任は人間に帰属する」というスタンスで運用することが最も賢明なアプローチと言えるでしょう。

AIの公平性とバイアスに関する注意点:倫理的・社会的リスク

AIの公平性とバイアスは、単なる技術的な問題にとどまらず、企業の倫理観や社会的責任に関わる重要な注意点です。契約レビューにおいても、AIのバイアスが予期せぬリスクを生み出す可能性があります。

学習データのバイアス:

- 注意点: AIは学習したデータの特徴を反映します。もし学習データが特定の地域、業界、性別、人種などに偏っていた場合、AIはその偏りをそのまま学習し、契約レビューの際にも不公平な判断を下す可能性があります。例えば、特定の業界の契約書ばかりを学習したAIが、別の業界の契約書をレビューする際に、その業界の慣行や特殊性を理解できず、誤ったリスク評価をしてしまうことが考えられます。

- 対策: AIツールベンダーに対し、学習データの構成、多様性、バイアス低減策について確認を求めましょう。また、自社でAIを導入する際には、特定の種類の契約書や案件に特化して学習させることで、意図しないバイアスを避ける工夫も必要です。

差別的な表現の生成:

- 注意点: 学習データに過去の差別的な表現や偏見が含まれていた場合、AIがそれを学習し、契約書の修正案やコメントに差別的・不適切な表現を生成してしまうリスクがあります。これは企業の社会的信用を大きく損なうだけでなく、法的にも差別禁止規定に抵触する可能性があります。

- 対策: AIツールに特定のキーワードや表現をフィルタリングする機能があるか確認し、積極的に活用しましょう。また、出力された文章については、差別的表現や不適切な表現がないかを人間の目で徹底的にチェックする体制を構築することが必須です。

倫理的AIのガバナンス:

- 注意点: AIが複雑な判断を下す際、その「思考プロセス」がブラックボックス化されていることがあります(説明可能性の欠如)。法務部門としては、なぜAIがそのようなリスク評価や修正案を提示したのか、その根拠を説明できなければ、責任を果たすことはできません。

- 対策: AIの判断根拠を可視化する機能(例:参照条文や根拠資料の提示)を持つツールを選定することが望ましいです。また、AIの倫理ガイドラインを策定し、AIの利用目的、範囲、禁止事項などを明確に定めることで、倫理的なAI活用を推進する必要があります。

AIの公平性やバイアスは、技術的な解決策だけでなく、企業としての倫理観とガバナンス体制が問われる問題です。法務部門は、単なる法的リスクだけでなく、企業価値やレピュテーションリスクの観点からも、これらの問題に真摯に向き合う必要があります。

リスク最小化のためのガバナンス構築と戦略的導入:実践的注意点

生成AIを安全かつ効果的に契約レビューに導入するためには、単にツールを導入するだけでなく、組織的なガバナンス体制を構築し、戦略的な導入計画を立てることが不可欠です。ここでは、実践的な注意点と具体的なステップを見ていきましょう。

組織的なガイドラインの策定と運用体制における注意点

AIを導入するからには、会社のルールを明確にし、みんなでそのルールを守る運用体制を整えることが最も重要です。

利用目的と範囲の明確化:

- 注意点: 「何でもAIに任せる」という漠然とした利用は、責任範囲の曖昧化やリスク増大につながります。

- 対策: AIを利用する目的(例:定型契約の一次レビュー、特定リスク条項の検出など)と、その利用範囲(例:秘密保持契約、業務委託契約に限定するなど)を具体的に定義します。例えば、「機密性の高い契約書は原則としてAIレビューの対象外とする」といったルールを設けることも考えられます。

利用者の権限と責任の明確化:

- 注意点: 誰がAIツールにアクセスでき、誰がその出力結果に責任を持つのかが曖昧だと、トラブル発生時に責任の押し付け合いになってしまいます。

- 対策: AIツールの利用対象者を限定し、それぞれの役割に応じたアクセス権限を設定します。例えば、法務部員のみにレビュー権限を付与し、事業部門の担当者にはAIによる簡易チェック機能のみを提供するといった運用が考えられます。また、AIの出力結果を最終確認し、承認する責任者は誰かを明確に定めます。

「ヒューマン・イン・ザ・ループ(HITL)」原則の明文化:

- 注意点: AIの出力を鵜呑みにする文化が生まれると、重大なミスを見落とすリスクが高まります。

- 対策: 「AIはあくまで補助ツールであり、最終的な判断と責任は人間が負う」という原則をガイドラインに明記し、全利用者に周知徹底します。具体的な確認プロセス(例:AIが指摘したリスク箇所は必ず人間が根拠を確認する、AIが提案した修正案は必ず人間の法務担当者が文言を調整する)を定めることが重要です。

データ入力・出力に関するルール:

注意点: どのようなデータをAIに入力し、出力されたデータをどのように扱うかに関するルールがなければ、情報漏洩や誤用につながります。

対策:

入力データに関するルール: 機密性の高いデータや個人情報を含むデータの入力制限、特定のフォーマットでの入力義務などを定めます。

出力データに関するルール: AIが生成したデータの保存方法、社内外への共有制限、誤りがあった場合の修正・報告義務などを明記します。

モニタリングと改善サイクル:

- 注意点: ガイドラインを策定して終わり、では意味がありません。運用状況を定期的にチェックし、問題点があれば改善していく必要があります。

- 対策: AIツールの利用ログを定期的に確認し、誤検知率や誤出力率、ハルシネーションの発生状況などをモニタリングします。利用者からのフィードバックを収集し、ガイドラインや運用体制、AIツールの設定を継続的に改善していくPDCAサイクルを回します。

これらのガイドラインを策定する際は、法務部門だけでなく、情報システム部門、コンプライアンス部門、事業部門など、関連部署と密接に連携し、全社的な合意形成を図ることが重要です。

ヒューマン・イン・ザ・ループ(HITL)の設計と必須要件における注意点

生成AIの契約レビューにおいて、最も重要なキーワードの一つが「ヒューマン・イン・ザ・ループ(HITL)」です。これは「人間がプロセスの中に常に介入し、最終的な判断と責任を担う」という考え方で、AI活用のリスクを最小化するための必須要件となります。

HITLの具体的な設計:

注意点: 「人間が確認する」と漠然と言うだけでは、実効性が伴いません。

対策:

- 段階的レビュー: AIが一次レビューを行い、リスクの高い箇所やAIが判断に迷った箇所のみを人間に提示する。人間はこれらの箇所に集中して最終確認を行う。

- 複数人でのチェック: 特に重要な契約書については、AIレビュー後、複数の法務担当者によるクロスチェックを行う。

- AIからの根拠提示: AIがなぜそのように判断したのか、その根拠(参照条文、過去の類似契約、リスクポリシーなど)を明確に提示する機能を活用し、人間がその根拠を検証できるようにする。

- 修正とフィードバック: AIが提示した修正案を人間が手直しし、その修正内容をAIにフィードバックすることで、AIの精度向上にも貢献する。

法務担当者のスキルセットの変革:

- 注意点: AIを導入することで、法務担当者の仕事がなくなる、という誤解や不安が生じることがあります。

- 対策: 法務担当者には、AIの出力を「批判的に検証する能力」と「AIを使いこなす能力」が求められるようになります。具体的には、

- AIリテラシー: AIの仕組み、得意なこと・苦手なことを理解する。

- プロンプトエンジニアリング: AIに適切な指示(プロンプト)を与え、質の高い出力を引き出すスキル。

- 高度な法的判断能力: AIが提示できないような複雑な法的問題や、戦略的な判断を下す能力。

- コミュニケーション能力: 事業部門に対してAIのレビュー結果を説明し、説得する能力。

これらのスキル習得を目的とした研修プログラムを導入し、法務担当者のリスキリングを支援することが不可欠です。

AIの限界を理解させる教育:

- 注意点: AIは万能であるという誤った認識が、過信とリスクにつながります。

- 対策: 法務部門だけでなく、AIツールを利用する可能性のある事業部門の担当者にも、AIのハルシネーション、知識の陳腐化、コンテクスト理解の限界といった「限界」について教育を徹底します。「AIが提示した情報は必ず人間が確認する」というルールを徹底するための教育が重要です。

HITLは、AIの恩恵を最大限に享受しつつ、そのリスクを最小限に抑えるための「生命線」です。これをいかに効果的に設計し、運用できるかが、生成AI契約レビューの成否を分けると言っても過言ではありません。

適切なAIツールの選定基準とベンダーとの契約戦略における注意点

世の中にはたくさんのAI契約レビューツールがあります。その中から自社に合ったツールを選び、ベンダーと適切な契約を結ぶことは、導入成功のための重要なステップです。

AIツールの選定基準(チェックリスト):

- 注意点: 機能性や価格だけでツールを選んでしまうと、後々後悔することになります。

- 対策: 以下の項目を総合的に評価しましょう。

- セキュリティ・機密保持対策: データ暗号化、保存場所、アクセス管理、学習データ利用ポリシー、情報漏洩時の対応プロトコルなど。最優先項目です。

- 機能性: どのような契約書の種類に対応しているか、リスク特定、条項抽出、修正案提案の精度、レビュー速度、多言語対応、カスタマイズ性(自社テンプレートへの対応など)。

- 信頼性・正確性: ハルシネーション発生率、誤検知率、特定の分野における専門性。可能であれば、既存ユーザーからの評価や、導入実績を確認。

説明可能性(Explainability): AIがなぜそのように判断したのか、根拠を提示する機能があるか。

- ユーザビリティ: 直感的に操作できるか、既存のシステム(契約管理システムなど)との連携はスムーズか。

- コスト: 初期費用、月額費用、従量課金制の場合はその単価、バージョンアップ費用など、トータルコストを把握。

- サポート体制: 導入支援、操作トレーニング、技術サポートの充実度、SLAの内容。

- ベンダーの信頼性: 企業の安定性、法務分野への知見、将来的なロードマップ。

ベンダーとの契約戦略における注意点:

注意点: ベンダー有利の契約内容で合意してしまうと、自社のリスクが増大します。

対策:

- データ利用に関する条項: 最も重要です。「入力データは自社の同意なく学習に利用しない」という条項を必ず盛り込むか、明確なオプトアウトの仕組みを確認します。データの廃棄、返還についても規定します。

- 情報セキュリティに関する条項: ベンダーが講じるべきセキュリティ対策、監査権、情報漏洩時の報告義務と責任範囲を具体的に明記します。セキュリティに関する国際規格(ISO 27001など)の取得状況も確認します。

- 免責条項と責任制限: ベンダーがAIの出力結果に対する一切の責任を免除するような過度な免責条項は、可能な限り修正交渉を行います。損害賠償の上限額も交渉の対象です。ただし、ベンダー側も「AIは完璧ではない」という立場なので、合意点を見つけることが重要です。

- SLA(サービスレベルアグリーメント): 稼働率、応答時間、サポート対応時間など、サービスの品質に関する具体的な基準を定めます。基準を満たせない場合のペナルティについても交渉材料とします。

- 準拠法と紛争解決: どの国の法律が適用され、紛争が起きた場合にどのように解決するか(裁判管轄、仲裁など)を明確に定めます。

- 知的財産権: AIの学習データ、AIが生成した出力物に関する知的財産権の帰属について、明確な条項を設けます。

複数のベンダーから情報を収集し、トライアル利用を通じて、実際の業務にどれだけフィットするかを検証することも重要です。契約交渉では、法務部門が主導権を握

り、自社にとって不利な条項は粘り強く交渉することが求められます。

結論と今後の展望:リスクを機会に変える法務生成AIの未来

生成AIの登場は、法務部門にとって大きな変革の波をもたらしています。それは単なる業務効率化に留まらず、法務のあり方そのものを問い直す契機となるでしょう。リスクを適切に管理しながら、このテクノロジーを戦略的に活用することで、法務部門は未来に向けてさらなる進化を遂げることができます。

法務生成AIの未来像:リスク管理を基盤とした機会創出

未来の法務部門は、生成AIを単なる「レビューツール」としてではなく、「戦略的な意思決定を支援するパートナー」として活用するようになるでしょう。

リスク予測とプロアクティブな対応:

- 未来像: AIは、過去の契約データ、訴訟履歴、業界トレンド、法改正情報などを統合的に分析し、将来発生しうる法的リスクを予測できるようになります。例えば、特定の条項が多い契約書が将来的に訴訟に発展するリスクが高いことをAIが示唆し、未然に手を打つことができるようになるかもしれません。

- 機会: 法務部門は「問題が起きてから対処する」受動的な役割から、「問題を未然に防ぎ、事業の成長をサポートする」プロアクティブな役割へと進化します。

契約交渉の最適化:

- 未来像: AIは、交渉相手の過去の交渉履歴や業界標準データに基づき、最適な交渉戦略や譲歩範囲をリアルタイムで提案できるようになるかもしれません。これにより、交渉の成功率が高まり、より有利な条件で契約を締結できる可能性が広がります。

- 機会: 法務部門は、単にリスクを回避するだけでなく、積極的に企業価値を最大化するための交渉戦略に貢献できるようになります。

パーソナライズされたリーガルアドバイス:

- 未来像: 生成AIは、個々の企業や事業部門のニーズに合わせて、よりパーソナライズされた法的アドバイスや契約ドラフトを瞬時に生成できるようになります。これにより、事業部門は法務部門に依頼する前に、AIを活用して一次的な法的疑問を解消し、業務スピードを向上させることができます。

- 機会: 法務部門は、定型的な質問対応から解放され、より高度で複雑な案件に集中できるようになります。

グローバル法務の効率化:

- 未来像: 多言語対応能力に優れた生成AIは、異なる法域の法律や商慣習を瞬時に理解し、多様な言語の契約書をレビュー・ドラフトできるようになります。これにより、グローバル展開する企業にとって、法務コストの削減と効率的な海外事業展開が可能になります。

- 機会: 法務部門は、海外事業の拡大を強力に後押しする、グローバルな法務戦略の中核を担う存在となります。

これらの未来を実現するためには、引き続き「リスク管理」が基盤となります。AIの進化に伴い新たなリスクも生まれる可能性があり、それらを常に予測し、適切なガバナンスを構築し続けることが、未来の法務部門の生命線となるでしょう。AIを恐れるのではなく、その力を理解し、賢く付き合っていく姿勢が求められます。

日本における法務テックの進化と新たな法的枠組み

日本においても、法務テック(Legal Tech)の進化は目覚ましく、生成AIの活用は今後さらに加速していくでしょう。しかし、その進化を支えるためには、法的な枠組みや社会的な合意形成が不可欠です。

法務テック市場の拡大と競争:

- 現状: 日本でも多くのスタートアップや大手企業が法務テック市場に参入し、AI契約レビュー、AIによるリーガルリサーチ、契約管理システムなど、多様なサービスが提供され始めています。

- 展望: 今後、生成AIを活用したサービスはさらに多様化・高度化し、市場競争も激化するでしょう。これにより、より高品質で使いやすいツールが生まれることが期待されます。法務部門は、これらのサービスを賢く選定し、自社のニーズに合った最適なソリューションを導入する能力が求められます。

AIに関する法的議論と規制の動き:

- 現状: 日本では、AIに関する包括的な基本法はまだありませんが、著作権法、個人情報保護法、景品表示法など、既存の法律との関係性が議論されています。政府はAI戦略を策定し、国際的な議論にも積極的に参加しています。

- 展望: 今後、AIが社会に与える影響が大きくなるにつれて、AIの利用に関する新たな法的枠組みやガイドラインが整備されていくでしょう。特に、AIの責任問題、著作権、倫理的利用、データガバナンスといった分野での議論が活発化し、具体的な法整備が進む可能性があります。法務部門は、これらの動向を常に注視し、自社のAI活用ポリシーを適応させていく必要があります。

弁護士法との関係:

- 現状: 日本では弁護士法第72条(非弁活動の禁止)により、弁護士以外の者が報酬を得て法律事務を行うことが制限されています。AIによる法的アドバイスや契約レビューが、この「法律事務」に該当するのかどうかは、重要な論点です。

- 展望: 現時点では、AIが「最終的な法的判断」を行うことは弁護士法に抵触する可能性が高いと考えられています。そのため、AIはあくまで「弁護士や法務担当者の業務を支援するツール」として位置づけられ、最終的な判断は人間が行うという運用が継続されるでしょう。今後、AIの能力向上に伴い、この線引きに関する議論が深まる可能性がありますが、法務部門としては、非弁活動と見なされないよう、常に注意を払う必要があります。

法務人材の育成とキャリアパスの多様化:

- 現状: 法務人材には、伝統的な法的知識に加え、データサイエンス、AIリテラシー、プロジェクトマネジメントといった新たなスキルが求められ始めています。

- 展望: AIを使いこなし、ビジネスと法務の橋渡しができる「リーガルオペレーションズ」の専門家や、「法務テクノロジスト」といった新たなキャリアパスが生まれるでしょう。法務部門は、こうした変化に対応できるよう、人材育成に積極的に投資し、組織全体のスキルアップを図る必要があります。

生成AIは、法務部門に大きな挑戦と同時に、無限の可能性をもたらしています。目の前のリスクに臆することなく、しかし盲目的に突っ走ることもなく、一歩一歩着実に、そして戦略的に導入を進めることが重要です。

AIは、私たち法務担当者から仕事を奪うものではありません。むしろ、定型的な業務から私たちを解放し、より創造的で、より戦略的で、より本質的な法務業務に集中するための強力な「相棒」になってくれるはずです。

この技術革新の波に乗り、リスクを乗り越え、未来の法務部門を一緒に創造していきましょう!皆さんの法務部門が、生成AIの力を借りて、さらにパワーアップすることを心から願っています。