はじめに:なぜ今、EU AI法が重要なのか?

世界初の包括的AI規制としてのEU AI法

現代社会において、人工知能(AI)は私たちの生活やビジネスに不可欠なものとなりつつあります。自動運転、医療診断、金融取引、顧客サービスに至るまで、その応用範囲は日々拡大し、私たちの生活の質を向上させ、経済活動を効率化する無限の可能性を秘めています。しかし、その急速な発展と普及の裏側で、AIがもたらす倫理的、法的、社会的な課題もまた、無視できないものとなっています。プライバシー侵害、差別、透明性の欠如、誤情報拡散、さらには人権侵害に至る可能性まで、AIの負の側面に対する懸念は世界中で高まっています。

こうした背景の中、欧州連合(EU)は2024年5月に「EU AI法(EU AI Act)」を採択し、その歴史に新たな一歩を刻みました。これは、AIの設計、開発、導入、利用に関する包括的な規制を定めた、世界初の法案です。EUは、デジタル市場における主導的な地位を確立し、信頼できるAIの開発と利用を促進すると同時に、市民の基本的権利と安全を保護することを目的としています。この法律は、単にEU域内の企業に影響を与えるだけでなく、その「域外適用」という特徴により、EU市場でビジネスを行う世界中の企業、特に日本企業にも直接的な影響を及ぼすことになります。

日本企業にとっての重要性と本ガイドの目的

日本企業にとって、EU AI法は決して対岸の火事ではありません。多くの日本企業がEU市場で事業を展開しており、AI関連製品やサービスを提供している場合、この法律への対応は避けて通れません。AIシステムを開発・提供する企業はもちろんのこと、自社サービスにAI技術を組み込んでいる企業、さらにはEU域内のデータを用いてAIを学習・運用している企業も、その規制対象となる可能性があります。

EU AI法への対応を怠れば、巨額の罰金、事業活動の停止、ブランドイメージの失墜といった深刻な事態を招きかねません。しかし、適切に対応し、信頼性の高いAIシステムを構築することは、EU市場における競争優位性を確立し、国際的な信頼を得るチャンスでもあります。

本ガイドでは、EU AI法の全体像、その核となる「リスクベースアプローチ」、企業に与える具体的な影響、そして日本企業が今すぐ取り組むべき対策について、徹底的に解説します。さらに、日本のAI規制動向との比較や、グローバルなAIガバナンスの潮流にも触れ、企業がAI時代の新たなルールにどのように適応していくべきかを提示します。このガイドが、日本企業の皆様がEU AI法の複雑な要件を理解し、適切な戦略を策定するための一助となれば幸いです。

EU AI法とは何か?その全体像と特徴

EU AI法の目的:信頼できるAIの促進と基本的権利の保護

EU AI法の根底にあるのは、「信頼できるAI(Trustworthy AI)」という概念です。EUは、技術革新を阻害することなく、人間中心で倫理的なAIの開発と利用を促進することを目指しています。具体的には、以下の二つの主要な目的を掲げています。

- 基本的権利と安全の保護: AIシステムが、市民のプライバシー、データ保護、非差別、人間の尊厳といった基本的権利を侵害しないよう、具体的な保護措置を講じること。特に、健康、安全、公共の秩序に影響を及ぼす高リスクなAIシステムに対しては、厳格な規制を適用し、潜在的な危害を最小限に抑えることを目指します。

- 信頼できるAI市場の確立: AIの設計、開発、導入、利用に関する明確なルールを設けることで、イノベーションを促進しつつ、AI市場の信頼性と透明性を高めること。これにより、EU域内外の企業が安心してAI技術を開発・利用できる環境を整備し、欧州経済の競争力を強化することを目指しています。

この法律は、単にAIの利用を制限するだけでなく、その信頼性を担保することで、AIが社会に最大限の利益をもたらすための枠組みを提供しようとするものです。

法的性質:「規則」としての法的拘束力と域外適用

EU AI法は、EUの法令の中でも「規則(Regulation)」として採択されました。これは「指令(Directive)」とは異なり、各加盟国が国内法に転換する必要がなく、採択後、特定の猶予期間を経て、EU全域で直接的に適用されることを意味します。これにより、EU市場全体で一貫したAI規制が適用され、法的な不確実性が低減されるというメリットがあります。

さらに、EU AI法の最大の特徴の一つが、その**域外適用(Extraterritoriality)**の原則です。これは、EU域外の企業であっても、以下のいずれかの条件に該当する場合、EU AI法の適用対象となることを意味します。

- EU市場にAIシステムを投入する、またはサービスを提供する企業: たとえ日本に本社を置く企業であっても、開発したAIシステムやAIを活用したサービスをEU域内の顧客に提供する場合、EU AI法の規制を受けます。

- EU域内でAIシステムを利用する企業: たとえEU域外で開発されたAIシステムであっても、EU域内のユーザーが利用する場合、そのAIシステムのプロバイダー(開発者)や導入者(デプロイヤー)は規制対象となる可能性があります。

- AIシステムの出力がEU域内で利用される場合: たとえば、EU域外の企業が開発したAIが生成した情報やデータが、EU域内で重要な意思決定に利用されるようなケースも対象となり得ます。

この域外適用原則は、EUの一般データ保護規則(GDPR)でも見られたものであり、世界中の企業に広範な影響を与えることになります。日本企業は、自社のビジネスモデルとAI利用実態を詳細に分析し、EU AI法の適用範囲を正確に理解する必要があります。

成立経緯と最新の適用状況(2025年最新動向含む)

EU AI法の成立は、数年にわたる議論と交渉の集大成です。その道のりは、複雑かつ多岐にわたるステークホルダーの意見調整を伴うものでした。

2.3.1 2021年の提案から2024年の成立までの道のり

EU AI法の制定プロセスは、2021年4月に欧州委員会が最初の法案を提案したことから始まりました。この法案は、AIに対するリスクベースアプローチを提唱し、その後の議論の土台となりました。その後、欧州議会とEU理事会の間で集中的な交渉(三者協議)が行われ、特に生成AIの扱いや顔認証技術に対する規制の厳格化などが主要な争点となりました。

2023年12月には、暫定的な合意が形成され、2024年3月には欧州議会が正式に採択しました。そして、224年5月にEU理事会が承認したことで、EU AI法は正式に成立し、官報に掲載されました。この法律の成立は、AIガバナンスにおける歴史的な転換点として、世界中で注目されています。

2.3.2 交渉の主要な争点:生成AIと顔認証の扱い

交渉プロセスにおいて特に議論を呼んだのは、急速に進化する生成AI(Generative AI)の扱いです。

当初の法案では、生成AIに対する明確な規定が少なかったものの、ChatGPTなどの登場により、その影響力の大きさが浮き彫りになり、急遽規制対象に追加されることになりました。具体的には、生成AIの開発者に対しては、透明性、データ品質、サイバーセキュリティ、環境への配慮に関する新たな義務が課せられました。また、ディープフェイクなどの合成メディアには、それがAIによって生成されたものであることを明確に開示する義務が求められています。

顔認証技術については、公共空間でのリアルタイム生体認証システムの使用は原則禁止としつつ、テロ対策や誘拐犯捜索など、厳格な条件と司法の承認の下でのみ例外的に許可されることになりました。これは、市民のプライバシーと自由に対するAIの潜在的な脅威に対し、EUが強い姿勢で臨むことを示すものです。

2.3.3 段階的な適用スケジュール:2025年2月からの禁止事項と今後の義務化

EU AI法は、その複雑さと広範な影響を考慮し、段階的に適用されていくことになります。法律の正式施行後、以下のようなスケジュールで各条項が順次発効します。

- 施行後6ヶ月(2024年冬頃): AIシステムを用いた操作的行動や社会信用評価など、許容できないリスクに分類されるAIシステムの使用禁止規定が発効します。これは最もリスクの高いAIに対する即時的な規制であり、企業は速やかに対応する必要があります。

- 施行後12ヶ月(2025年春頃): コード・オブ・プラクティス(行動規範)の規定が発効します。

- 施行後24ヶ月(2026年春頃): 高リスクAIシステムに関する主要な義務(品質管理システム、適合性評価など)が発効します。この期間が、多くの日本企業にとって最も重要な準備期間となります。

- 施行後36ヶ月(2027年春頃): 特定の古いAIシステムに関する義務など、残りのすべての規定が発効します。

日本企業は、この段階的な適用スケジュールを正確に把握し、自社のAIシステムがどのタイミングでどの規制に服するのかを特定することが重要です。特に2025年2月からの禁止事項と、2026年春頃に義務化される高リスクAIシステムに関する規定には、早急な対応が求められます。

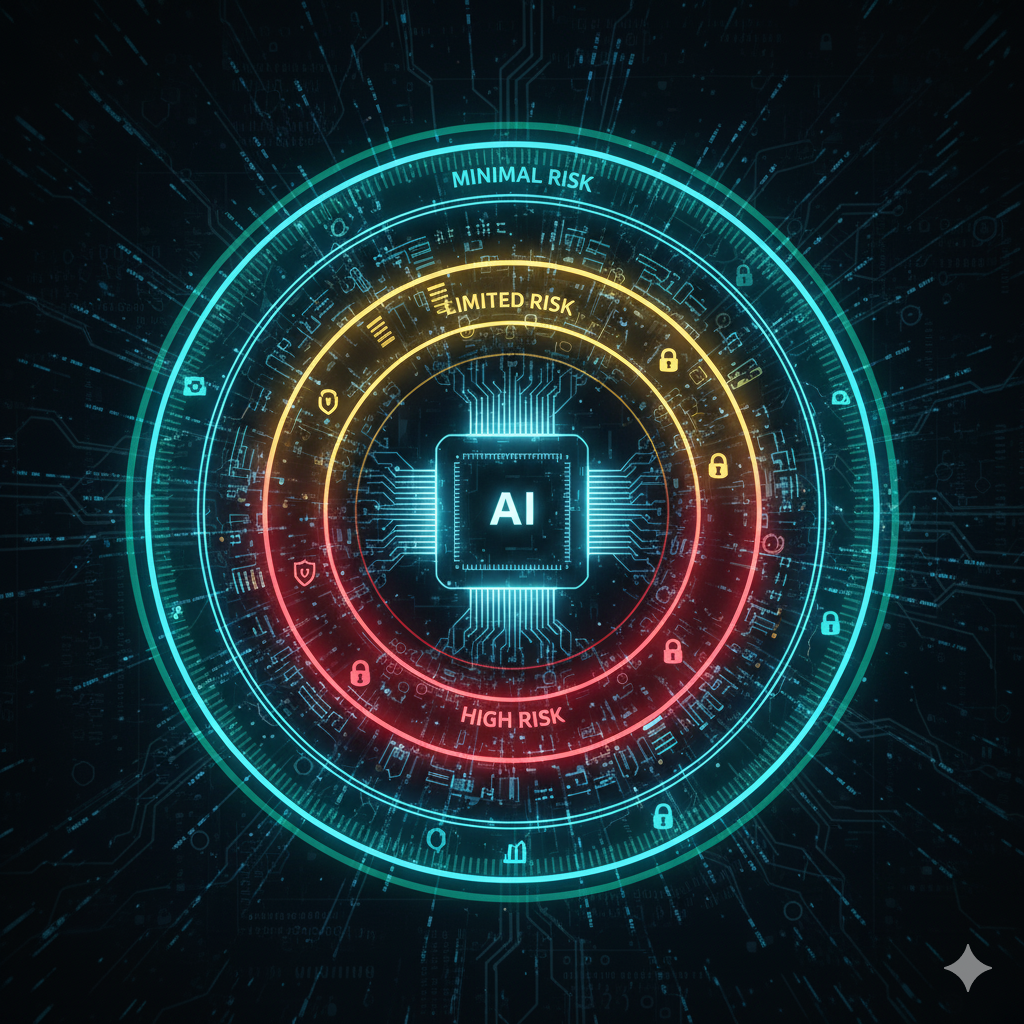

EU AI法の核心:リスクベースアプローチの詳細

EU AI法の最も特徴的な要素は、AIシステムが社会にもたらす潜在的なリスクのレベルに応じて、異なる規制要件を課す「リスクベースアプローチ」を採用している点です。これにより、イノベーションを阻害することなく、真に危険性の高いAIシステムに焦点を当てた効果的な規制を目指しています。

4段階のリスク分類とその定義

EU AI法では、AIシステムをそのリスクレベルに応じて以下の4つのカテゴリーに分類します。

3.1.1 許容できないリスク(Unacceptable Risk) – 原則禁止

このカテゴリーに分類されるAIシステムは、人間の基本的権利を脅かし、社会に深刻な危害をもたらす可能性が極めて高いため、原則としてEU域内での利用が禁止されます。これには、以下のようなAIシステムが含まれます。

- 人間のサブミナル行動を操作するAI: 意図的に無意識的な行動を誘導し、人間が自由な意思決定を行う能力を阻害するAI。

- 脆弱性を悪用するAI: 特定の個人グループ(年齢、身体的または精神的障害などにより脆弱な人々)の脆弱性を悪用し、その行動に影響を与えるAI。

- 政府による社会信用評価システム: 中国の社会信用システムのような、国民の行動を評価し、そのスコアに基づいて社会的権利やサービスへのアクセスを制限するAI。

- リアルタイム遠隔生体認証システム(公共空間): 公共の場所で顔認識技術などを用いて、特定の個人をリアルタイムで識別するAI。ただし、テロ対策や誘拐犯捜索など、厳格な条件と司法の承認の下でのみ例外的に許可されます。

- 予測的警察活動(プロファイリング): 特定の個人が犯罪を犯す可能性を予測し、その情報に基づいて警察が介入するAI。

これらのAIシステムは、EUの価値観と人権原則に根本的に反するとみなされており、開発・導入が禁止されます。

3.1.2 高リスク(High Risk) – 厳格な監査と規制の対象

高リスクAIシステムは、人々の健康、安全、基本的権利に重大な危害を与える可能性のあるAIを指します。これらのAIシステムは、その利用分野の重要性から厳格な規制と適合性評価の対象となります。具体的には、以下の分野で利用されるAIが「高リスク」と分類されます。

- 重要なインフラストラクチャー: 交通、エネルギー、水、デジタルインフラなど、生命や健康に不可欠なサービスを管理・運用するAI。

- 教育および職業訓練: 大学入試の採点、キャリアガイダンス、教師の評価など、個人の教育的・職業的機会に影響を与えるAI。

- 雇用、労働者管理、自営業者へのアクセス: 採用選考、従業員の監視、昇進・解雇の決定などに使用されるAI。

- 特定の公共サービス(社会保障、医療など): 社会給付の決定、医療診断、治療計画などに使用されるAI。

- 法執行: 犯罪リスク評価、証拠評価、捜査支援などに使用されるAI。

- 移民、亡命、国境管理: 渡航書類の審査、難民申請の評価などに使用されるAI。

- 司法・民主主義プロセスにおける行政: 裁判所の判断支援、選挙結果の集計などに使用されるAI。

- 安全構成部品として使用されるAI: 玩具、医療機器、自動車など、製品の安全性を確保するために組み込まれるAI。

高リスクAIシステムは、市場投入前および運用中に、設計から開発、導入、運用、監視に至るまでライフサイクル全体にわたって厳格な義務を遵守する必要があります。

3.1.3 限定的リスク(Limited Risk) – 透明性義務

限定的リスクのAIシステムは、ユーザーに誤解を与える可能性や、操作的な影響を与える可能性があるものの、高リスクAIシステムほど重大な危害を引き起こすものではないと判断されます。これらのAIシステムには、主に透明性に関する義務が課せられます。

- チャットボットやバーチャルアシスタント: ユーザーは、自分がAIと対話していることを知らされる必要があります。

- 感情認識システムや生体認証分類システム: これらのシステムを使用する場合、ユーザーは認識されていることを知らされる必要があります。

- ディープフェイクや合成メディア: AIによって生成または操作された画像、音声、動画である場合、その旨が明確に表示される必要があります。

透明性義務は、ユーザーがAIの存在や性質を認識し、情報に基づいた判断を下せるようにすることを目的としています。

3.1.4 最小限のリスク(Minimal Risk) – 規制対象外

最小限のリスクのAIシステムは、EU AI法において特定の規制義務が課せられないAIシステムです。これには、迷惑メールフィルターやAIを利用したゲーム、基本的な検索エンジン、在庫管理システムなど、一般的に人間の基本的権利や安全にほとんど影響を与えないと判断されるAIが含まれます。

これらのシステムは、規制の対象外ではありますが、開発者や導入者は、倫理的ガイドラインや自主的な行動規範(コード・オブ・プラクティス)に従うことが奨励されています。イノベーションを促進しつつ、必要に応じて自律的な責任を促すアプローチです。

高リスクAIシステムに対する具体的な規制要件

高リスクAIシステムに分類された場合、開発者(プロバイダー)および導入者(デプロイヤー)には、非常に詳細かつ厳格な義務が課せられます。これらは、AIシステムの信頼性と安全性、透明性を確保するための基盤となります。

3.2.1 品質管理システムとリスクマネジメント

プロバイダーは、AIシステムの設計、開発、製造、検査、インストール、メンテナンスに至るまで、製品ライフサイクル全体にわたる堅牢な品質管理システムを確立し、維持する必要があります。これには、組織体制、プロセス、手順、文書化が含まれます。

同時に、AIシステムのライフサイクル全体を通じて、継続的なリスクマネジメントシステムを導入し、潜在的なリスクを特定、評価、軽減するプロセスを確立する必要があります。これには、リスク評価、リスク低減策の実施、およびその有効性の継続的なモニタリングが含まれます。

3.2.2 データガバナンスとデータ品質

高リスクAIシステムの学習に使用されるデータセットは、高品質であり、偏り(バイアス)がなく、差別的でないことを保証する必要があります。プロバイダーは、以下の義務を負います。

- データガバナンスの確立: データの収集、管理、利用に関する明確なルールと責任体制を確立すること。

- データ品質の確保: 学習データの代表性、関連性、完全性、正確性を確保するための手順を導入すること。特に、人種、民族、性別、年齢などの機微な属性に関するバイアスを特定し、軽減するための措置を講じる必要があります。

- データ収集慣行の透明性: 学習データの収集方法とその出所に関する情報を提供すること。

3.2.3 技術文書の作成と記録保持

プロバイダーは、AIシステムに関する詳細な技術文書を作成し、少なくとも10年間保管する必要があります。この文書には、AIシステムの設計、機能、目的、性能、開発プロセス、データセット、アルゴリズム、テスト結果、リスクマネジメントに関する情報などが含まれ、市場監視当局の求めに応じて提出できるようにする必要があります。

また、AIシステムの運用中に行われたイベント(ログデータなど)を自動的に記録する機能を備え、その記録も保持する義務があります。これにより、AIシステムの決定や行動を事後的に追跡、分析、検証することが可能となります。

3.2.4 透明性と情報提供義務

高リスクAIシステムのプロバイダーは、ユーザー(導入者)に対して、そのAIシステムに関する明確かつ包括的な情報を提供する必要があります。これには、AIシステムの目的、機能、性能(精度、堅牢性、セキュリティ)、既知の制限事項、予測可能な誤用に関する情報などが含まれます。

さらに、AIシステムの決定プロセスを理解できるように、その内部動作に関する一定の透明性を確保する義務もあります。

3.2.5 人間による監視

高リスクAIシステムは、常に人間による適切な監視が可能であるように設計・開発される必要があります。これは、AIシステムが予期せぬ挙動を示したり、誤った判断を下したりした場合に、人間が介入し、その影響を修正または軽減できるようにするためです。

具体的には、人間のオペレーターがAIシステムの出力を理解し、必要に応じてシステムの停止や再設定を行えるようなインターフェースや手順が求められます。

3.2.6 堅牢性とセキュリティ

AIシステムは、技術的な堅牢性(ロバストネス)とサイバーセキュリティの要件を満たす必要があります。これには、以下の側面が含まれます。

- エラーや故障に対する耐性: AIシステムが、予期せぬ入力やシステム障害に対して、適切なレベルの精度と安全性を維持すること。

- 敵対的攻撃への耐性: サイバー攻撃やデータ操作など、悪意のある行為からAIシステムを保護すること。

- セキュリティの確保: AIシステムのデータやインフラストラクチャが、不正アクセス、漏洩、改ざんから保護されること。

3.2.7 適合性評価とCEマーキング

高リスクAIシステムをEU市場に投入するプロバイダーは、そのシステムがEU AI法の要件を遵守していることを示す**適合性評価(Conformity Assessment)**を受けなければなりません。この評価は、多くの場合、第三者機関による監査を通じて行われます。適合性が確認されたAIシステムには、CEマーキングが義務付けられます。CEマーキングは、製品がEUの安全、健康、環境保護に関する基準を満たしていることを示すものであり、EU市場での販売許可証のような役割を果たします。

EU AI法が企業に与える影響と潜在的コスト

EU AI法は、EU市場で事業を展開する企業、特にAI技術に関わる企業に広範囲かつ多大な影響を及ぼします。これは単なる技術的な課題ではなく、経営戦略、法務、組織体制、さらには企業文化にまで及ぶ可能性を秘めています。

運用コストの増加:コンプライアンス体制構築の費用

EU AI法への準拠には、少なからず初期投資と継続的な運用コストが発生します。

- コンプライアンスチームの設置・強化: 法務、セキュリティ、技術、倫理の専門知識を持つ人材を確保し、コンプライアンス体制を構築する必要があります。新たな人材の採用や既存従業員の再教育にコストがかかります。

- システム改修費用: AIシステムの設計変更、データガバナンスの強化、ログ記録機能の追加、セキュリティ対策の強化など、既存システムの改修や新たなシステムの導入に費用が発生します。

- 第三者適合性評価費用: 高リスクAIシステムの場合、第三者機関による適合性評価が義務付けられるため、その監査費用が発生します。

- 文書化と監査対応: 膨大な技術文書や記録の作成・管理、および市場監視当局による監査への対応には、人的リソースと時間が必要です。

- 法的アドバイス: 複雑な法律の解釈と適用には、専門の弁護士やコンサルタントへの継続的な相談費用がかかるでしょう。

これらのコストは、特に中小企業にとっては大きな負担となる可能性があり、事前の綿密な計画と予算確保が不可欠です。

ビジネスモデルの再評価と戦略変更の必要性

EU AI法は、企業のビジネスモデル自体にも再評価を促す可能性があります。

- 製品・サービスポートフォリオの見直し: AIシステムの分類と規制要件に基づいて、製品やサービスの開発計画を見直す必要があります。高リスクに分類される可能性のあるAIシステムについては、開発コストとリスクを考慮し、事業継続の是非を判断する必要が生じるかもしれません。

- データ収集戦略の変更: AIの学習データに関する厳格な要件は、データの収集、処理、利用の方法に大きな影響を与えます。データの匿名化や擬似匿名化、同意取得プロセスの見直しなどが必要となり、データ戦略全体の変更が求められるでしょう。

- 開発プロセスとガバナンスの変革: アジャイル開発などの迅速な開発手法を採用している場合でも、AIのライフサイクル全体にわたる品質管理、リスクマネジメント、文書化のプロセスを組み込む必要があります。これは、開発組織のガバナンス体制に根本的な変革を促します。

- パートナーシップ戦略の再検討: AIサプライチェーン全体における責任分担が明確化されるため、AI関連技術やサービスを提供するベンダーとの契約内容を見直す必要があります。

コンプライアンスを経営戦略の中心に据え、AI活用のロードマップ全体を再検討することが求められます。

競争力の強化とイノベーションへの影響

一見すると、EU AI法は企業にとって負担と制約を増やすように見えますが、長期的には競争力強化の機会にもなり得ます。

- 信頼性の高いAIとしての差別化: EU AI法に準拠したAIシステムは、その信頼性と透明性が公的に保証されることになります。これは、顧客やパートナーからの信頼獲得に繋がり、市場における強力な差別化要因となります。特に、AIの信頼性や倫理性が重視されるEU市場では、コンプライアンスは競争優位性の源泉となり得ます。

- イノベーションの質の向上: 規制への対応を通じて、企業はAIシステムの設計、開発、運用プロセスを改善し、より高品質で倫理的なAIを創出するノウハウを蓄積できます。これは、長期的な視点で見れば、より持続可能で社会受容性の高いイノベーションに繋がります。

- 国際的な標準化への貢献: EU AI法は、世界のAI規制のベンチマークとなる可能性を秘めています。この法律に早期に対応することは、将来的な国際標準化プロセスにおいて、自社の知見や技術を反映させる機会にも繋がるかもしれません。

ただし、過度な規制がイノベーションの足を引っ張る可能性も否定できません。特に、研究開発段階のAIやスタートアップ企業にとっては、負担が大きすぎるという懸念も示されています。EUは、サンドボックス制度の導入などを通じて、このバランスを取ろうとしています。

厳しい罰則:最大で全世界売上高の7%

EU AI法は、違反に対する非常に厳しい罰則を設けています。その内容は、GDPRに匹敵する、あるいはそれを上回るほどのインパクトを持つ可能性があります。

- 禁止されているAIシステムに関する違反: 最大3,500万ユーロまたは全世界年間売上高の7%のいずれか高い方。

- 特定のデータガバナンス要件などの違反: 最大1,500万ユーロまたは全世界年間売上高の3%のいずれか高い方。

- 情報提供義務や不正確な情報提供などの違反: 最大750万ユーロまたは全世界年間売上高の1.5%のいずれか高い方。

これらの罰則は、企業の財務状況に壊滅的な打撃を与える可能性があります。特に全世界売上高に対する割合で罰金額が算出されるため、グローバル企業にとってはそのリスクが極めて高くなります。罰則のリスクを回避するためには、積極的かつ継続的なコンプライアンスへの取り組みが不可欠です。

日本企業が今すぐ準備すべき対策

EU AI法は、単なる法務部門だけの問題ではありません。経営層から現場のエンジニアまで、全社的な取り組みが不可欠です。日本企業が取るべき対策は、段階的かつ戦略的に進める必要があります。

ステップ1:現状把握とAIシステムのリスク分類

まず、自社が関与するAIシステムがEU AI法の適用対象となるか、そしてどのリスクカテゴリーに分類されるかを正確に把握することから始めます。

5.1.1 自社が提供・利用するAIシステムの棚卸し

企業は、現在開発中、提供中、または社内で利用しているすべてのAIシステムを詳細にリストアップする必要があります。これには、以下の情報を含めるべきです。

- AIシステムの名称と目的: 何のために開発・利用されているのか。

- プロバイダー/デプロイヤーの特定: 自社がプロバイダー(開発・供給者)なのか、デプロイヤー(導入・利用者)なのか、あるいはその両方なのか。

- 技術スタックとアーキテクチャ: どのような技術が使われているか。

- 利用状況と対象ユーザー: EU域内で利用されているか、EU市民が対象か。

- 学習データの出所と性質: どのようなデータで学習され、そのデータはEU域内のものであるか、機微な個人情報を含んでいるか。

- AIシステムの出力と影響: AIの決定が、個人の権利、安全、社会経済活動にどのような影響を与える可能性があるか。

- ライフサイクル段階: 研究開発、プロトタイプ、実運用中など、どの段階にあるか。

この棚卸しは、AIシステムの「資産台帳」を作成するようなイメージです。

5.1.2 各AIシステムのリスクレベルの分類と特定

棚卸しで得られた情報に基づき、各AIシステムが「許容できないリスク」「高リスク」「限定的リスク」「最小限のリスク」のいずれに該当するかを分類します。

- 「許容できないリスク」に該当しないか: まず、自社のAIが禁止されるカテゴリーに該当しないかを厳しくチェックします。該当する場合は、そのAIシステムの開発・利用を直ちに中止するか、抜本的な見直しが必要です。

- 「高リスク」の判断: EU AI法の附属書IIIにリストアップされている高リスク分野に該当するかを確認します。また、たとえリストにないAIシステムであっても、健康、安全、基本的権利に重大な危害を与える可能性があれば、高リスクと判断される可能性があります。判断に迷う場合は、専門家(弁護士、コンサルタント)の意見を求めることが重要です。

- 「限定的リスク」・「最小限のリスク」の判断: 高リスクに該当しない場合、透明性義務の対象となる「限定的リスク」か、規制対象外の「最小限のリスク」かを判断します。特に生成AIは、限定的リスクとして特定の透明性義務が課せられる点に注意が必要です。

このリスク分類は、その後の対応の優先順位と深度を決定する上で最も重要なステップとなります。

ステップ2:コンプライアンス体制の確立と強化

AIシステムのリスク分類が終わったら、企業は組織全体でEU AI法に準拠するための体制を確立・強化する必要があります。

5.2.1 法務・技術・事業部門間の連携強化

EU AI法への対応は、特定の部門のみで完結するものではありません。

- 法務部門: 法令解釈、契約書の見直し、罰則リスクの評価と助言。

- 技術・開発部門: AIシステムの設計変更、データ品質の確保、ログ機能の実装、セキュリティ強化、技術文書の作成。

- 事業部門: ビジネスモデルの見直し、ユーザーへの情報提供、市場投入戦略の調整。

- 経営層: 全社的な方針決定、予算配分、リスク管理の最終責任。

これらの部門が横断的に連携し、情報共有と意思決定を円滑に行うための体制(例:AIガバナンス委員会、専門タスクフォース)を構築することが不可欠です。

5.2.2 専門家の活用(弁護士、コンサルタントなど)

EU AI法は非常に複雑であり、その解釈や具体的な適用には高度な専門知識が求められます。

- 法務顧問: EU法に精通した弁護士(特にGDPR対応経験のある事務所)から、法的助言を受けることが重要です。契約書の見直しや、EU当局とのコミュニケーションにおいても不可欠な存在となります。

- 技術コンサルタント: AI倫理やセキュリティに関する専門知識を持つコンサルタントは、技術的な要件を満たすための具体的なソリューションや実装方法について助言を提供できます。

- 認証機関: 高リスクAIシステムの場合、第三者適合性評価を行う認証機関との連携も視野に入れる必要があります。

自社内のリソースだけでは対応しきれない部分を、外部の専門家で補完する戦略が効果的です。

ステップ3:高リスクAIシステムへの具体的な対応

高リスクAIシステムに分類された場合、企業は以下の具体的な措置を講じなければなりません。

5.3.1 リスク評価と影響度分析(DPIA)の実施

高リスクAIシステムについては、市場投入前および運用中に、継続的なリスク評価を実施することが義務付けられます。これには、プライバシー影響評価(DPIA:Data Protection Impact Assessment)のような、AIシステムが個人の権利や自由に与える影響を特定し、評価するプロセスが含まれます。

- AIシステムのライフサイクル全体における潜在的なリスク(技術的故障、バイアス、セキュリティ脆弱性など)を特定。

- 特定されたリスクの発生確率と影響度を評価。

- リスクを軽減するための具体的な対策を立案し、実施。

- これらのプロセスと結果を詳細に文書化。

5.3.2 要件を満たすためのシステム改修と文書化

EU AI法の要件を満たすために、AIシステムの設計、開発、運用プロセスを改修します。

- データガバナンスの強化: 学習データの収集、クリーニング、ラベリングプロセスを厳格化し、偏りのないデータセットを確保。データトレーサビリティの仕組みを導入。

- 透明性機能の実装: AIの決定プロセスを説明可能にするための機能(例:SHAP, LIMEなどのXAI技術)の組み込み。ユーザーへの情報開示インターフェースの開発。

- セキュリティ機能の強化: AIシステムに対するサイバー攻撃(ポイズニング攻撃、敵対的攻撃など)への耐性強化、データ保護対策の実施。

- 人間による監視機能: 人間がAIシステムの挙動を監視し、必要に応じて介入できるようなインターフェースやアラートシステムの設計。

- 技術文書の作成と整備: AIシステムの仕様、開発履歴、データセット情報、テスト結果、リスク評価レポートなど、EU AI法が求めるすべての技術文書を作成し、最新の状態に保つ。

5.3.3 内部監査と継続的モニタリング体制の構築

AIシステムのライフサイクル全体を通じて、継続的にコンプライアンスを維持するための体制を構築します。

- 内部監査の実施: 定期的に社内監査を実施し、AIシステムがEU AI法の要件を満たし続けているかを確認。監査結果に基づいて改善計画を策定・実行。

- 継続的なモニタリング: AIシステムの運用状況を継続的に監視し、新たなリスクの発生や性能の低下などを早期に検知する仕組みを導入。特に、時間の経過とともにAIの性能が劣化する「AIドリフト」や、新たなバイアスが発生する可能性に注意。

- インシデント対応計画: AIシステムに関連するインシデント(セキュリティ侵害、重大な誤作動、人権侵害の可能性など)が発生した場合の対応計画を策定し、訓練を実施。

ステップ4:透明性と説明責任の確保

EU AI法は、AIの透明性と説明責任を強く求めています。これは、ユーザーの信頼を得る上で不可欠な要素です。

5.4.1 ユーザーへの情報開示と同意取得のプロセス

- 明確な情報提供: AIシステムがどのような目的で、どのように機能するか、その限界と潜在的なリスクについて、ユーザーに分かりやすく情報を提供します。特に限定的リスクのAI(チャットボット、ディープフェイクなど)では、AIとの対話であること、AIによって生成されたものであることを明確に表示する必要があります。

- 同意取得の設計: 個人データを利用する場合や、個人の権利に影響を与える可能性のあるAIシステムの場合、関連するデータ保護法規(GDPRなど)と連携し、適切な同意取得プロセスを設計・実施します。

5.4.2 AIの意思決定プロセスの可視化と説明能力の向上

高リスクAIシステムは、その決定プロセスが不透明であってはなりません。

- 説明可能なAI(XAI)の導入: AIの判断根拠を人間が理解できる形で説明する技術(XAI:Explainable AI)の導入を検討します。これにより、AIが特定の決定を下した理由をユーザーや規制当局に説明できるようになります。

- 人間の介入ポイントの確保: AIの最終的な決定が、常に人間のレビューや承認を経る仕組みを設計し、人間の説明責任を明確化します。

- フィードバックメカニズムの構築: AIの決定に対するユーザーからのフィードバックを受け付け、それをシステム改善に活かす仕組みを導入します。

日本のAI規制との比較:ハードローとソフトローの対比

EU AI法が世界的な注目を集める中、各国・地域もそれぞれ異なるアプローチでAI規制を進めています。特に、日本のAI規制動向は、EUとは対照的な「ソフトロー」アプローチを採用しており、その比較は日本企業にとって自社の戦略を検討する上で重要な視点を提供します。

日本のAI戦略と法整備の現状

日本は、AI技術の開発・活用において、経済成長と社会課題解決の両立を目指す姿勢を明確にしています。政府は「AI戦略2022」などの文書を通じて、AIの研究開発を推進しつつ、AIの適切な利用に向けたガイドライン策定や倫理原則の浸透に注力しています。

日本のAIに関する法整備は、特定のAIに特化した包括的な法律を制定するよりも、既存の法律(個人情報保護法、著作権法、製造物責任法など)の枠組みの中でAIの課題に対応し、必要に応じてガイドラインや指針を策定するというアプローチが主流です。例えば、AI開発者向け、AI利用者向けの各種ガイドラインや、AI倫理原則などが経済産業省や総務省から発表されています。

また、直近では、生成AIの急速な普及を受け、政府は「AI事業者ガイドライン(案)」を策定し、AIを開発・提供・利用する事業者が遵守すべき行動指針を示しました。これらは、法的拘束力を持つ「ハードロー」ではなく、自主的な取り組みを促す「ソフトロー」としての性格が強いのが特徴です。

EU AI法(ハードロー)と日本のアプローチ(ソフトロー)

EU AI法と日本のAI規制アプローチの最大の違いは、「ハードロー」と「ソフトロー」という法的拘束力の有無にあります。

| 特徴 | EU AI法(ハードロー) | 日本のアプローチ(ソフトロー) |

| 法的拘束力 | 高い(規則としてEU全域で直接適用、違反には罰則) | 低い(ガイドライン、指針であり法的拘束力は原則なし) |

| アプローチ | リスクベース規制(AIの機能・用途で分類、義務を詳細規定) | 自主規制・倫理原則・既存法規の適用が中心 |

| 目的 | 市民の基本的権利と安全保護、信頼できるAI市場の確立 | AIの社会実装とイノベーション促進、倫理的利用の啓発 |

| 域外適用 | あり | なし(日本の国内法として適用) |

| 規制対象 | 特定のAIシステム(特に高リスクAI) | AIを開発・提供・利用する事業者全般(推奨事項) |

EUの「ハードロー」アプローチは、法的確実性を提供し、企業に明確な義務を課すことで、市民の権利保護と信頼性の高いAI市場の構築を目指します。しかし、その厳格さゆえに、イノベーションを阻害する可能性や、新技術への対応の遅れといった課題も指摘されています。

一方、日本の「ソフトロー」アプローチは、企業の自主的な取り組みを尊重し、イノベーションの自由度を高く保つことを重視します。技術の急速な進化に対応しやすい柔軟性がある一方で、法的拘束力がないため、実効性や企業の遵守レベルにばらつきが生じる可能性が課題となります。

日欧間の相互運用性と連携の可能性

アプローチは異なるものの、日欧はAIに関する共通の価値観、特に「人間中心」「倫理的」「信頼できる」AIの実現を目指す点で一致しています。この共通の目的意識は、国際的な協力と連携の基盤となり得ます。

- 規制の相互運用性: 将来的には、日欧間でAI規制の相互運用性(Interoperability)を高めるための議論が進む可能性があります。これは、企業が複数の法域で異なる複雑な規制に対応する負担を軽減し、国際的なAIビジネスを円滑化するために重要です。

- 国際標準化への貢献: 日本は、AIに関する技術標準化活動に積極的に参加しており、EU AI法への対応経験を通じて得られた知見は、国際標準の策定において重要な役割を果たすことができます。

- 信頼できるAIエコシステムの構築: 日本企業がEU AI法に準拠することで、グローバルな信頼できるAIエコシステムの一員としての地位を確立し、欧州市場だけでなく、他の市場におけるビジネスチャンスを拡大できる可能性があります。

日本企業は、自社のAIシステムがEU AI法の適用対象となるかどうかを慎重に判断し、もし対象となる場合はEU法への厳格な準拠を最優先しつつ、日本のソフトローアプローチで求められる倫理的配慮やガイドラインへの対応も並行して進める必要があります。これにより、日欧両方の市場で信頼されるAI事業者としての地位を確立できるでしょう。

グローバルなAI規制の潮流とEU AI法の位置づけ

EU AI法は、単にEU域内のルールに留まらず、世界のAIガバナンスにおける新たなベンチマークを確立しつつあります。各国・地域がそれぞれの背景と価値観に基づいてAI規制の検討を進める中、EU AI法は、その厳格さと包括性から、他の規制動向に大きな影響を与えています。

米国、中国、英国など主要国のAI規制動向

世界中でAI規制の動きが活発化しており、それぞれ異なるアプローチが見られます。

- 米国: EUのような包括的なAI法はまだありませんが、ホワイトハウスによる「AIに関する大統領令」や、国立標準技術研究所(NIST)による「AIリスク管理フレームワーク」など、行政命令や自主的なガイダンスを通じてAIの安全かつ責任ある開発・利用を促進しています。州レベルでは、特定のAI利用(例:雇用におけるAI)に関する規制が導入され始めています。米国の特徴は、イノベーション促進を重視し、業界主導の自主規制を優先する傾向がある点です。

- 中国: 世界で最も早くAI規制に着手した国の一つであり、既存のインターネット規制の枠組みを活用しつつ、生成AIやアルゴリズム推薦システムなど、特定のAI技術に焦点を当てた規制を導入しています。特に、データ保護、アルゴリズムの透明性、倫理的原則(社会主義的価値観との調和)を重視し、国家の統制力を強化する側面も持ち合わせています。

- 英国: イノベーションを重視するアプローチを取っており、既存の規制機関(競争市場庁、情報コミッショナーオフィスなど)がAIの特定の側面を監督する「機能横断型アプローチ」を提案しています。EU AI法のような包括的な法律ではなく、柔軟なフレームワークを通じてAIのリスクに対応しようとしています。しかし、EU AI法の動向も注視しており、今後の政策に影響を与える可能性はあります。

- その他の国々: カナダでは「AIとデータに関する法案(AIDA)」が提案され、AIのリスクベース規制を目指しています。ブラジルでは「過度なリスクのあるAI」の開発禁止を盛り込んだ法案が検討されています。韓国は欧州に続く2番目の包括的なAI法「AI基本法」の制定を進めており、EU AI法の影響が色濃く出ています。これらの動きは、EU AI法がグローバルな「AI規制のドミノ効果」を引き起こしていることを示唆しています。

世界に広がるAI規制のドミノ効果

EU AI法は、その厳格な「ハードロー」アプローチと「域外適用」原則により、世界中の企業や政府に多大な影響を与えています。これは、かつてGDPRが個人データ保護の国際標準を確立したのと同様に、「ブリュッセル効果」として知られる現象をAIガバナンスの分野でも引き起こしつつあります。

- 国際的な規制のベンチマーク: EU AI法は、各国が自国のAI規制を検討する際の有力な参考資料となっています。EU市場でビジネスを行う企業は、EU AI法に準拠する必要があるため、その対応策が事実上のグローバルスタンダードとなり、他の市場にも波及効果をもたらす可能性があります。

- コンプライアンスの複雑化: 複数の国・地域で異なるAI規制が導入されることにより、グローバル企業はより複雑なコンプライアンス要件に直面することになります。これは、企業が国際的に事業展開する上での新たな課題となります。

- 信頼性への意識の高まり: EU AI法が求める高い基準は、AIシステムの信頼性、透明性、安全性に対する国際的な意識を高めます。これにより、AIを開発・利用するすべての企業が、倫理的配慮や責任あるAIガバナンスの重要性を再認識するきっかけとなります。

国際標準化と今後の展望

AIガバナンスにおける多様なアプローチが並存する中で、国際的な協調と標準化の重要性が増しています。G7やOECDといった国際的な枠組みでは、AI倫理原則や責任あるAIガイドラインの策定が進められています。

- 国際標準化団体の役割: ISO(国際標準化機構)やIEEE(電気電子学会)などの標準化団体は、AIの品質、セキュリティ、信頼性、倫理に関する技術標準の策定を加速させています。EU AI法の技術要件の多くは、既存または今後策定される国際標準と連携して運用されることが期待されます。

- 日欧間の協力の深化: 日本とEUは、AI倫理や技術標準化において共通の価値観を有しており、今後も協力関係を深化させることが期待されます。例えば、AI開発におけるベストプラクティスの共有や、規制の相互運用性に関する対話を通じて、グローバルなAIガバナンスを共同でリードしていく可能性があります。

- 企業の役割: 企業は、単に規制に受動的に従うだけでなく、国際的なAIガバナンスの議論に積極的に参加し、自社の経験や知見を共有することで、より実用的で効果的な規制や標準の策定に貢献できるでしょう。

EU AI法は、AIの発展と社会の調和を追求する上での大きな一歩です。この法律が示す方向性は、今後のグローバルなAIガバナンスの潮流を形作っていくことになります。

まとめ:EU AI法への対応は企業の未来を左右する

信頼できるAIの構築に向けた企業努力の重要性

AIが私たちの社会に深く浸透するにつれて、その信頼性と倫理性が問われる時代となりました。EU AI法は、この問いに対するEUからの明確な回答であり、AIシステムに透明性、説明責任、堅牢性、そして人間中心の設計を求めるものです。日本企業がこの法律に適切に対応することは、単なる法令遵守を超え、信頼できるAIを構築するという企業としての責任を果たすことと同義です。

信頼できるAIの構築は、技術的な課題だけでなく、組織文化、倫理観、そして経営戦略全体に関わる複合的な取り組みです。データの収集からモデルの開発、デプロイ、そして運用後の監視に至るまで、AIシステムのライフサイクル全体を通じて、リスクを特定し、倫理的配慮を組み込むプロセスが不可欠となります。これにより、予期せぬバイアスやプライバシー侵害、セキュリティ脆弱性といった潜在的なリスクを最小限に抑え、AIが社会に最大限の価値を提供できる基盤を築くことができます。

競争力強化のための前向きな対応

EU AI法への対応は、企業にとって一時的な負担や制約と捉えられがちですが、長期的視点で見れば、競争力強化のための強力な機会となり得ます。

- ブランドイメージの向上: EU AI法に準拠した「信頼できるAI」を提供する企業は、顧客、パートナー、投資家からの信頼を獲得し、ブランド価値を高めることができます。特に、AIの倫理性が重視される今日の市場において、これは強力な差別化要因となります。

- リスク管理の強化: 厳格なコンプライアンス体制を構築する過程で、企業はAIに関する潜在的なリスクを早期に特定し、管理する能力を向上させることができます。これにより、法的罰則や評判リスクを回避し、持続可能な事業運営が可能となります。

- 新たなビジネスチャンスの創出: EU AI法への準拠は、EU市場へのアクセスを確保するだけでなく、信頼性の高いAIソリューションを求める他の市場への展開も容易にします。また、コンプライアンスを支援する新たなサービスや技術開発の機会も生まれるでしょう。

EU AI法を「義務」としてだけでなく、「投資」として捉え、前向きに取り組むことが、企業の未来を左右する重要な経営判断となります。

継続的な情報収集と専門家との連携

AI技術は日進月歩であり、それを取り巻く法規制やガイドラインも常に進化しています。EU AI法も、具体的な実装規則やガイダンスが今後も追加される可能性があります。そのため、企業は継続的な情報収集と学習を怠ってはなりません。

- 最新動向の把握: EU委員会、欧州議会、各国の監督機関などからの公式発表、ガイダンス、FAQなどを定期的に確認し、最新の情報を把握することが重要です。

- 社内体制の柔軟性: 変化する規制環境に迅速に対応できるよう、社内のコンプライアンス体制やAIガバナンス体制を柔軟に保つ必要があります。

- 専門家ネットワークの活用: EU法務に精通した弁護士、AI倫理の専門家、サイバーセキュリティのコンサルタントなど、外部の専門家との連携を強化し、継続的なサポートを受けることが成功の鍵となります。

EU AI法は、AI時代の新たなルールブックです。この法律を深く理解し、戦略的に対応することで、日本企業はグローバル市場における競争力を高め、信頼されるAIのリーダーとして新たな価値を創造できるでしょう。